̫ƽ��Ƽ� ��ҵ

���廪�Ľ�Transformer���ý������ԭ������ע������һ�����ߴ���

����λ

���ϱ༭��̫ƽ��Ƽ�

�����ڣ�2024-11-04 16:40

����λ

���ϱ༭��̫ƽ��Ƽ�

�����ڣ�2024-11-04 16:40

-

�����廪�Ŷ����������һ���µĸĽ���Transformerģ�ͣ���ΪDIFF Transformer����ģ��ͨ�����ע���������������ͳTransformer�д��ڵ�ע����ƫ�����⡣

|

Transformer��������ʹ����ʣ����и�Сë��һֱû����� �ܰ���ע�������ڲ���ص������ϣ�Ҳ��������ȵ��� ����������Ժ���廪�Ŷӳ��֣����ȫ�¸Ľ���Differential Transformer��ר�������ë�����������顣

�����н��ܣ�����˼·���Ʋ�ַŴ��·����������������źŵIJ�ֵ���˳���ģ������

���嵽������ģ���У�������Ӻܳ���ֻ������token������Ӱ�쵱ǰtoken�ĺ��塣��ע������������ÿ������֮��������������оͰ������������ˡ� �Ŷ�����ķ�������ע������������һ��Softmax��Ȼ������Softmax�������� ��һ����������Ϣ�ͱ������������ע��������������������ϡ�

���Խ�ģ�����ϵ�һϵ��ʵ������ʾ������Լ65%��ģ�ʹ�С��ѵ��tokens��DIFF Transformer���ܴﵽ�봫ͳTransformer�൱�����ܡ� �¼ܹ��ڳ������Ľ�ģ���ؼ���Ϣ���������ٻþ������������ѧϰ�����Լ����ټ����쳣ֵ�ȸ���ָ���У��ձ�����Transformer�ܹ���

�����ϴ���arXivƽ̨���в���ѧ�ߵ��������ʡ�һ��Tianzhu Ye���������ߴ����С�

���Transformer �봫ͳTranformer��ȣ�DIFF Transformer���ֺ�ۼܹ����䣬��Ҫ���������ò��ע�����滻��ͳsoftmaxע������ ���������LLaMAϵ���е�һЩ�Ľ�����pre-RMSNorm��һ����SwiGLU������� �ڲ��ע����ģ���У���Ҫ�ȸ�Q��K�ֳ������飬Ȼ��ֱ����softmax�� �ڶ������һ�������ˣ��ǿ�ѧϰ�IJ�������ͬһ���ע����ͷ֮�乲���� �˵�������Ϊ���ڲ�ֲ�����ƽ������ע�����Ĺ��ף�ʹ�ò��ע���������ܹ����õ���Ӧ��ͬ��������������ݷֲ���

��������һϵ��ʵ������ ���Խ�ģ������1T tokens��ѵ��3B��С��DIFF Transformer����ѭ StableLM-3B-4E1T���䷽���ڸ�����������������ǰѵ�����õ�Transformerģ����ȱ��ֳ����ơ� ����չ������ֻ��Լ65%��ģ�Ͳ�����ѵ��tokens��ƥ��Transformer�����ܡ�

�����������������ڶ���1.5B tokens��ѵ��3B��С��DIFF Transformer����չ�����ij�����64k�� ���������ij������ӣ��ۼ�ƽ����������Ȼ��NLL���������ͣ����ұȴ�ͳTransformer��NLLֵ���͡� ����DIFF Transformer������Ч���ò������ӵ������ġ�

�ؼ���Ϣ������������Ҳ���Ƕ�����롱�Ĵ��������飬���ò�ͬ�������ij��ȣ�4K��64K����ģ�ⲻͬ���ӳ̶ȵ���Ϣ���������� ��4K�����ij����£����Ų��� ���롱 �����Ͳ�ѯ���������ӣ�DIFF Transformer��ȷ�ʱ����ȶ�����Transformer ��ȷ�������½���

��64K�����ij����£�DIFF Transformer�ڲ�ͬ������ȣ����ؼ���Ϣ�ڳ��������е�λ�ã��������ij����¶��ܱ����ȶ����ܣ����ڹؼ���Ϣλ��������ǰ�벿��ʱ�������ԡ� �ر��ǵ��ؼ���Ϣλ��25%���ʱ��DIFF Transformer��Transformer��ȷ������� 76%��

������ѧϰ����������Ϊ�����Ƕ����������ֱ��Ƕ����������������ѧϰ���Ƚ��ԡ� ��������������ͬ��ʹ��64K�����ij��ȵ�3B����ģ�ͣ�DIFF Transformer��ȷ��ʼ�ո���Transformer���������ȴ�5.2%��21.6%����

������ѧϰ�Ƚ��Բ�������˳������DIFF Transformer�Ľ������ԶС�ڴ�ͳTransformer�� �����Ļþ�������Ҫ��ע�����а�����ȷ��ʵ����ģ����Ȼ������ȷ���������� ��ģ�������ground-truthһ��GPT-4o����GPT-4o���ж��Ƿ���ڻþ�����ǰ�������GPT-4o���������н��һ���ʽϸߣ���Կɿ��� �ڲ�ͬ���ݼ���DIFF Transformer��ȷ�ʸ��ߣ��þ����١� �����쳣ֵ����Transformer�еļ����쳣ֵ������ģ����ѵ������������������������ ����Ƚ���ע����logits������״̬���ּ��������µ����ֵ��DIFF Transformer�����ֳ����͵Ķ�������ֵ�����������ٵļ����쳣ֵ�� �ڶ�ע����logits��������ʵ��ʱ��DIFF Transformer�ڽ��ͱ��ؿ�������ʱ���ܱ��ֽϸ����ܣ���Transformer��6-bi ����ʱȷ�������½��� 4-bit��DIFF Transformer�ܴﵽ��6-bit��Transformer�൱��ȷ�ԣ��ұ�4-bit��Transformerȷ�����Լ 25%��

�����ѿ�Դ�� ���������������� ����Ŀǰ���ߵ����ʣ���������������� ����1��Diff Transformer��ÿ��ע����ͷ�¶ȿ�ѧϰ�ķ�����ʲô��ͬ�����ſ�ע�����Ա���Σ� ����Ӧ��ʵ���У���ѧϰ�¶�Ч���������ķ������ſ�ע�����ĸĽ���

����2�����ע�����Ƿ���ζ�Ž���ע����������������� ���߳��壬����ע����ͷά�ȷ���������ע����ͷ�������룬�����ڲ�����FLOPS�϶��Ƕ���ġ�

����3���ڶ���Softmax�˿�ѧϰ����lambda���о�˼·�� ����Ҳ������ϸ��Ӧ��

DIFF Transformer�ڴ�ѧ��Ȧ֮��Ҳ����dz�������ۣ��в��������������н������뽵���������ȡ� ��������ɼ����������������෴���źţ��������������Щ�ź�������������֪�ģ������ע�����в���������ȷ����Щ��������

һ�ֽ����ǣ���ע��������������Ҳ�кܵ͵��ݶȣ����ģ����ʵ��֪��Щ��������ֻ�ǵ���Softmax�����0��������������ȥ����

Ҳ����������������������ʵרҵ��Ƶ�С�ƽ���ߡ�������USB�������ȴ��䷽ʽ���ʺ�һЩ�� ʹ�������ź��ߴ��������źţ�������ֻ�Ա�����֮��IJ��죬�����ڿռ�����úܽ����ܵ��ĸ�������ͬ�ġ� ���õ������ź�����ᱻ�Ŵ���ͬ���������ȴ�������������ǿ������������

��֮��DIFF Transformer�����ѿ�Դ����unilm��Ŀ�£����л�����ħ�İ�֧�ֲ��ע������FlashAttention-2�Ĵ��롣 ����Ȥ�Ŀ����������ˡ�

������Դ������λ |

ԭ����Ŀ

IT�ٿ�

��������

�۳�ֵ•��ѡ

-

- ������HiVi��M200��ԴHiFi���� ����2.0�������� �ʼDZ�̨ʽ�������� ���ÿ�����������

-

��1079.1

��1199.0

- ���գ�HP��HyperX��Ӱ����PRO 16��Ϸ���ʼDZ�����U7-255HXRTX5060 16G 1T QHD 240Hz ����200W+

-

��12498.0

��12498.0

- Haida�����¿�UV��95mm�˾�NanoPro U-LR 1%������99.9%����52������Ĥ���������������������

- ��100��5

-

��555.0

��615.0

- ���س���APP��֬�ӵ��ӳӳ����سӼ���ר�����ܾ�����������ü���ר�����������ӳ����س� �������APP��֬�� ��� �غ�ֻ�����

- ����1w+

-

��26.99

��27.0

- �� DJI O4 Air Unit ϵ���콢������FPVͼ�� 4K�����֡������ ���ʵ���ʱԶ����ͼ�� ���˻���� DJI O4 Air Unit Pro

- ����1w+

-

��1499.0

��1499.0

-

- JBL��������ͬ�������LIVE780NC����Ӧ���������������� ͷ��ʽ����ʽ �ܱ� ƻ����hoho����6.0 ���ذ���Ʒ��LIVE780NCƻ����

- ȯ��ʡ0.9

-

��1231.0

��1367.8

- ��Ϊ��HUAWEI��FreeClip ���ж��� ����ʽ������������ �����ȹ���� ������ �������� �ǿպ�

-

��799.0

��899.0

- �߲ʺ磨Colorful��ս�� GeForce RTX 5060 Ti ������ 8GB GDDR7 DLSS 4.5 �羺����Ϸ��Ƶ����Կ�

- ����Ʒ

-

��3129.0

��3179.0

- ��ɫ��ESR����ƻ��15W���߳䡿magsafe������������iPhone17promax/16/15/14/13/12/��Ϊ�ֻ������������� ��ƻ��15W���߳䡿�ǿ���حMagsafe����

-

��25.0

��109.0

- ���գ�HP����Ӱ����11��Ϸ���ʼDZ����� ���Ҳ�����R9 8945HX RTX5060 16G 1TBSSD QHD240Hz��

- ȯ��ʡ300

-

��8498.0

��8798.0

-

- ����USB/Type-C3.2���ٶ����� SD/TF3.0˫�����õ���ƽ���ֻ���pocket4/3���˻�ƻ��17�˶����

- ȯ��ʡ0.88

-

��43.91

��49.9

- vivo Pad5 ���� 12GB+256GB չ��ͼ ���Ҳ���15% ����������9300+ 12.1Ӣ����������� ƽ�����

- ����1w+

-

��2649.0

��2849.0

- �����ã�Nintendo�������ڱ�˰�֡�Alarmo���� ��������� 35����������������ϷԪ�� ԭװ�հ�Alarmo���� �ٷ�����

- ȯ��ʡ10

-

��548.0

��598.0

- ��Ϊ��ͯ�ֱ� 5X Pro��Ϊ�ֱ������ֱ����߶�λ�绰������

- ȯ��ʡ100

-

��1298.0

��1398.0

- ����������Y7000 AI�߾� �羺��Ϸ�ʼDZ�����(Ultra7 255HX 16G 1T RTX5060 2.5K 180Hz ��) ���Ҳ���

- ����3000+

-

��8999.0

��8999.0

-

- ��ţIT20 ���������С����ѥ�ӿڻ��������С������������Ӱ���������� ����ɫ��ʿ�桿

- ȯ��ʡ10

-

��214.0

��239.0

- iKF Nano�ռ���Ƶ�桾�����Ƽ�|56dBǿ�����롿ͷ��ʽ���������������������֤�������߶�����

- ȯ��ʡ0.9

-

��413.1

��459.0

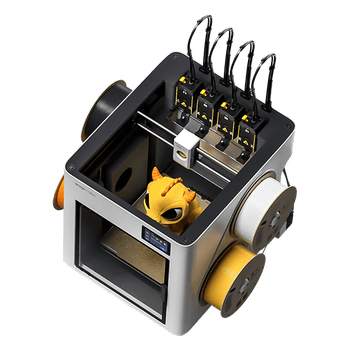

- SNAPMAKER����U1 3D��ӡ������4��ͷ��ɫ����ϸ߾��ȴ�ߴ�AI���ܼ�����������ٴ��ְ�ģ��5��ʡ��

-

��5399.0

��5999.0

- � D610 D750 24-120�� ȫ�������嵥������������۰��ж˵��� �걣����D610+24-85��ͷ �ٷ�����

- ȯ��ʡ220

-

��4772.0

��4992.0

- ����ʼDZ�����С��Pro16GT���ܱ� ���Ultra5 32G 1T 2.8K 120Hz OLED �����ᱡ�칫�� ���Ҳ���

- ȯ��ʡ80

-

��7299.0

��7799.0

����λ

����λ