̫ƽ��Ƽ� ��ҵ

����ŵ��������ѧ��Ϊɶ���AI��Hinton��Ilya 12��ǰ�Ի�������������ŵ��AI�籩��

����Ԫ

���ϱ༭��̫ƽ��Ƽ�

�����ڣ�2024-10-09 17:11

����Ԫ

���ϱ༭��̫ƽ��Ƽ�

�����ڣ�2024-10-09 17:11

-

ŵ��������ѧ�����AIѧ�ߣ��������顣Hinton��Hopfield�����������о��еĹ��������ǿ������˹�������ĸ��ˣ�����AI������ѧ��ϵ��������һ��������˼���Ƽ���Ľ���Ӱ�죬Ҳͻ����AI��������Ҫ�ԡ�

|

�����ŵ��������ѧ��һ������˲��ը��������Ȧ��AIȦ�� Hinton�ĵ�һ��Ӧ������Ȥ���ⲻ���Ǹ�թƭ�绰�ɣ�

��˳������ϵĽ������ ��ŵ�������Ĺٷ��˺ţ�Ҳ�������Ǹ��屬�ˡ� ���Ƿߺ����ⲻ������ѧ��

�����ݿ�ѧ���������ǡ����ڡ�����ѧ�������Բ����ǡ�����ѧ����

���֮�£�AIȦ����һƬ�������ڵľ������Ƕ����ĵظ�Hinton��ȥ��ף����

AI��ĸ��ɷɣ�AI����ԶӰ�죬���Ÿոտ�ʼ MIT��ʿ��Ziming Liuֱ�ԣ���Physics (Science) for AI����һ�������ص�������ģ������ʵ��һ�Զ��Ч������Ψ�п�ѧ���ܴ��������е�ͻ�ơ�

Jim Fan������һ���dz���Ȥ�ġ�AI-����ѧ���ձ�����

����ŵ����AIѧ���ǣ�����ѧ������ �Թ�������ŵ��������ѧ����Ϊ��Ҫ���AIѧ�ߣ� ���Ҫ�����ѧϰ��������һ�꽲�� Geoffrey Hinton��2012�꣬���ѧϰ�ľ��˸��� ����1986�꣬Geoffrey Hinton������Nature�Ϸ��������ģ�����ѵ�����������ġ������㷨����Ϊ��֪��

����˵���������ھ�����һ������֮���Դ˿�ʼ��������AI��̨�� 1989�꣬LeCun����ʹ���˷����;��������硣��Ҳͬ��Hinton�Ŀ�����

���ڵ�ͼ������ͷ �����������㷨�������ȳ����������1995�걻ͳ�ƻ���ѧϰ�ǹ�ȥ�ˡ� ͳ�ƻ���ѧϰ�ķ�ͷ��ʢ�˺ܶ��꣬��ʹ2006��Hinton��Science���״���������ѧϰ����ҵ��Ҳ��Ӧ���ȡ�

ֱ��2012��9�£�һƪ��Ϊ������Ⱦ������������ImageNetͼ����ࡹ�����ģ��ô�ǰ���Ŷ����AI�����ȶ�����

���������AlexNet��Ⱦ��������磬�ڵ����ImageNet����������ѹ֮�ƶ�ڣ�һ�ٽ�top-5�����ʽ��͵���15.3%��������ĵڶ�����26.2%������߳�10����ٷֵ㡣 ImageNet���ݼ���������˹̹����ɷ��Ŷ���2007�괴����

AlexNet�ݿ������Ĵ�ʤ�����о���Ա��̾�ڴ��;������������ܹ���������������ƪ����Ҳ��Ϊ���ѧϰ���˹������ԡ�AI�����������³�Ϊ�����������Ҫ��̱��� �������������ġ����ѧϰ��������Ҳ������Է��ˣ�ֱ��ʮ�����Ľ��졣 �º���ɷ������عˣ���2012�����������ѧϰ�ķ�չ���ơ�һ�����˵ĸ������������ζ�û�뵽���� �Դˣ����ǿ�ʼ���ţ������ݡ����������ģ�ͣ�������ͨ���˹����ܵĹؼ���Ҫ�ء� �����ģ��Ҳ������ľ��������磬����Ϊ�ݹ������硢Transformer����ɢģ�ͣ�ֱ�������GPT�� ������ѧ����ѧ��AI�����Ծ������˼�� ������ʱ��Ϊ��Ū�������Ĵ�����ι�����Hinton������������ѧϰ����ѧ��������ת����ѧ��������Ҳû�еõ���Ҫ�Ĵ𰸡�

���ǣ�Hintonȥ�˰���������ʼ�о�AI��ͨ��ģ����������У����������ۡ�

ij�����գ�Hinton���ڰ칫�ң�ͻȻ�������š�AI���˵ij��ִӴ�ת���� ���ŵ�����Ilya��

������ɬ��Ilya Hinton����Ilyaһƪ���ڷ��������ģ�Լ������һ�ܺ����ۡ�

����Hinton���۾�����һ�£��������ǻ��˺ü���ʱ����˼�������⡣

Ilya�������һ��ֱ����ֻҪ��������ģ������һ�㣬�ͻ�õ����õ�Ч����Hinton��Ϊ����һ���ӱܣ��������µ��뷨�����㷨���С� ����ʵ֤����Ilya�ǶԵġ� �µ��뷨ȷʵ��Ҫ��������Transformer�������¼ܹ�����ʵ���ϣ�����AI�ķ�չ��ҪԴ�����ݵĹ�ģ�ͼ���Ĺ�ģ�� 2011�꣬Hinton����Ilya����һ���о���James Martins��������һƪ�ַ���Ԥ������ġ�����ʹ��ά���ٿ�ѵ��ģ�ͣ�����Ԥ����һ��HTML�ַ��� ģ���״β�����Ƕ�루embedding���ͷ�������ÿ������ת��ΪǶ�룬Ȼ����Ƕ���������Ԥ����һ�����ŵ�Ƕ�룬��ͨ��������ѧϰ���ݵ���Ԫ�顣 ��ʱ�����Dz�����ģ���ܹ������κζ�������ʵ����������ģ�ͷ·��Ѿ�ѧ����˼������������Ϣ����ѹ������ģ��Ȩ���С�

AI��Ρ��䡹������ѧ ��������������һ�����ʣ���Щ������ѧ��ʲô��ϵ�أ� ŵ��ίԱ��Ľ����ǣ��˹���������������ѧ����ѵ���ġ�

Geoffrey Hinton����Hopfield����Ϊ������������һ��ʹ�ò�ͬ�����������磺����������������������У�Hintonʹ�õ���ͳ������ѧ�Ĺ��ߣ���ѧϰ��ʶ�������е�ģʽ�� ��������AI������ѧ��ϵ���ˡ� ��������˴���һλ����John Hopfield�����Ǻ�����ѧ�Ĺ�ϵ������һЩ�� һ���Ա�֮��Hopfield�����ǰ�����ѧ������������С���������ģ����Կ���������ѧ�С���������ģ�͡�����չ��

���⣬Hopfield Network�Ͳ������������ǻ���������ģ�͡� ͳ����ѧԭ�������������ߵĺ��ġ����Ƕ�ʹ������ͳ����ѧ����������������ģ�ͽ����ģʽʶ������ݷ�����ص����⡣ ��ǰ�ߵ��У���������������Ѱ�������洢��ģʽ���Ӧ�����ȶ�״̬�������У���������ͨ�������ڵ�֮�����ӵ�Ȩ��������ѧϰ���ݵķֲ��� ���ˣ�ŵ��ίԱ�����Բ��˵�ˡ� John Hopfield��һ���뷨����������ѧ�� 20����80�������John Hopfield�ڼ�������ѧԺ������һ���ļ����ģ�͡���Hopfield Network�� ����Ϊ��ʽ��̫��ʱ�ļ���������������ԡ� ������Ϊ��Hopfield Networkģ�������Դ�����Ϣ�Ľṹ����������ӵĽڵ���ɣ����������е���Ԫһ���� �ڵ��е�����ǿ�Ⱦ��п����ԣ���ǿ��������ǿ���ӽ����γ���������˵�ġ����䡹��

Hopfieldѧ������Caltech�������ѧ����������ϵͳ�Լ����﹤�̽���Erik Winfree���͵��� Hopfield Network������ѧ�С���������ģ�͡���the spin glass model������չ���������������ִŻ�״̬�����Գ�֮Ϊ���ġ����䡹��

Hopfield��չ����һģ�ͣ��������˸����ӵ�����ģʽ�� ����֮����ʹ��һ���Ĺ�����ÿ�Ե�Ԫ��ÿ���ڵ㣩֮���в�ͬ������ǿ�ȣ������پ���������״̬�� ���Ĺ���֤���ˣ�����������Դ�����ָ��ӵ�ģʽ�����䣩�����ұ�֮ǰ�ķ������ӽ�����������ʽ�� Hopfield��һ�ֿ�ѧ�Ƶ��ӽDz������ģ�ͣ��������˹�������������ѧ֮�����ϵ�� ������ѧ�������ѧ�����ž�ƽ��Ϊ��Hopfield Network������ѧ����Ĺ����ǣ��������˼·ģ���˵�·�ṹ�� ����������ÿ����Ԫ��������Ŵ����͵��ݵ�����ɣ���ÿ����Ԫ�ʹ�����һ����Ԫ���� ������˹�ٴ�ѧ���ŷ������ϣ�Hopfield������ͬ���Ĺ۵㡣����Ϊ����Զ�������¿�ѧ����ͨ�������ڣ�������ѧ֪ʶ�Ľ�����ϡ�

����MIT-IBMʵ��������ѧ��Dmitry Krotov�����ˣ�Hopfield Networkһ���뷨���ٶ�����ѧ�Ʋ����˾��Ӱ�졣 ���Ƿֱ��ǣ�ͳ������ѧ���������ѧ���˹����ܡ���ѧ��

2023�꣬����������һƪNature���ģ���Hopfield Network��ͳ����������ѧ�ͻ���ѧϰ�ȶ��ѧ���У������˷�����

���ĵ�ַ��https://www.nature.com/articles/s42254-023-00595-y Krotov����Ҳ��Hopfield��������ƪ�о����������Hopfield Network�������˽�����Ϥ�����ˡ�

ͳ������ѧ ��ͳ������ѧ�У�Hopfield Model��Ϊ����о��Ĺ��ܶ�����Hamiltonian��֮һ�����ܶ���������ѧ�У�������ϵͳ����������������ϵͳ��Ϊ�Ĺؼ��� ��һģ���Ѿ�������������Ƶ����ġ������鼮����Ϊ����������ѧ�ҽ�����ѧ���˹����ܣ��ṩ������㡣 ����ŵ�������ٷ������˽��ͣ�����ѧϰģ�ͣ��ǻ�����������ʽ��

�������ѧ��AI �ڼ������ѧ�У�Hopfield Network�ս���AI������1974-1981�������������˹�������ĸ��ˡ� Hopfield��1982�귢�������ģ���־���ִ�������Ŀ�ʼ��

���ĵ�ַ��https://www.pnas.org/doi/10.1073/pnas.79.8.2554 �������Ķ���NeurIPS����Դ�����ݵ�1984-1986���ڼ�������ѧԺ���еı���Ϊ��Hopfests���Ļ��顣 �������ֱ���¾���Hopfield���������������ڹ������������о��еĺ��ĵ�λ�� John Moody��1991���NeurIPS���ļ��м�¼�������ʷ��

���⣬Hopfield Network��Ϊ���Ʋ�����������Restricted Boltzmann Machine����չ����Ҫ�����Դ��RBM���������ѧϰ�У���������Ҫ�����á� ���л���������ģ�ͣ�Energy Based Model�����������˹�����������һ����Ҫ�ķ�ʽ�� ��Ҳ�Ǵ�Hopfield���������ͼ����ģ�ͷ�չ������ ��ѧ ����ѧ����Hopfield Network��Ϊ��������������ģ�͵Ļ����� ��������������������������й���ɽ�µ��뷨���ѳ�Ϊ��ѧ�еľ���������

��Ρ�ŵ���粨����������Ҳ������ѧ�Ʒ�������ȫ�µ�˼���� ���ɷ��ϵ��ǣ�AI�Ѿ�������ȫѧ�ơ�ȫ���� �����ŵ��������ѧ�����AI��Ҳ��AI�������������߸�Ӱ���һ����ʵд�ա� ������Դ������Ԫ |

ԭ����Ŀ

IT�ٿ�

��������

�۳�ֵ•��ѡ

-

- ������HiVi��M200��ԴHiFi���� ����2.0�������� �ʼDZ�̨ʽ�������� ���ÿ�����������

-

��1079.1

��1199.0

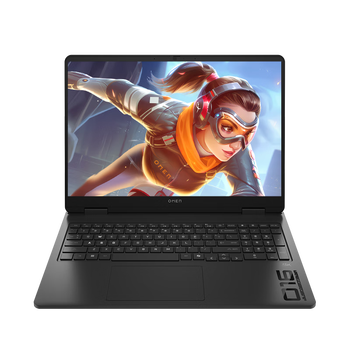

- ���գ�HP��HyperX��Ӱ����PRO 16��Ϸ���ʼDZ�����U7-255HXRTX5060 16G 1T QHD 240Hz ����200W+

-

��12498.0

��12498.0

- Haida�����¿�UV��95mm�˾�NanoPro U-LR 1%������99.9%����52������Ĥ���������������������

- ��100��5

-

��555.0

��615.0

- ���س���APP��֬�ӵ��ӳӳ����سӼ���ר�����ܾ�����������ü���ר�����������ӳ����س� �������APP��֬�� ��� �غ�ֻ�����

- ����1w+

-

��26.99

��27.0

- �� DJI O4 Air Unit ϵ���콢������FPVͼ�� 4K�����֡������ ���ʵ���ʱԶ����ͼ�� ���˻���� DJI O4 Air Unit Pro

- ����1w+

-

��1499.0

��1499.0

-

- JBL��������ͬ�������LIVE780NC����Ӧ���������������� ͷ��ʽ����ʽ �ܱ� ƻ����hoho����6.0 ���ذ���Ʒ��LIVE780NCƻ����

- ȯ��ʡ0.9

-

��1231.0

��1367.8

- ��Ϊ��HUAWEI��FreeClip ���ж��� ����ʽ������������ �����ȹ���� ������ �������� �ǿպ�

-

��799.0

��899.0

- �߲ʺ磨Colorful��ս�� GeForce RTX 5060 Ti ������ 8GB GDDR7 DLSS 4.5 �羺����Ϸ��Ƶ����Կ�

- ����Ʒ

-

��3129.0

��3179.0

- ��ɫ��ESR����ƻ��15W���߳䡿magsafe������������iPhone17promax/16/15/14/13/12/��Ϊ�ֻ������������� ��ƻ��15W���߳䡿�ǿ���حMagsafe����

-

��25.0

��109.0

- ���գ�HP����Ӱ����11��Ϸ���ʼDZ����� ���Ҳ�����R9 8945HX RTX5060 16G 1TBSSD QHD240Hz��

- ȯ��ʡ300

-

��8498.0

��8798.0

-

- ����USB/Type-C3.2���ٶ����� SD/TF3.0˫�����õ���ƽ���ֻ���pocket4/3���˻�ƻ��17�˶����

- ȯ��ʡ0.88

-

��43.91

��49.9

- vivo Pad5 ���� 12GB+256GB չ��ͼ ���Ҳ���15% ����������9300+ 12.1Ӣ����������� ƽ�����

- ����1w+

-

��2649.0

��2849.0

- �����ã�Nintendo�������ڱ�˰�֡�Alarmo���� ��������� 35����������������ϷԪ�� ԭװ�հ�Alarmo���� �ٷ�����

- ȯ��ʡ10

-

��548.0

��598.0

- ��Ϊ��ͯ�ֱ� 5X Pro��Ϊ�ֱ������ֱ����߶�λ�绰������

- ȯ��ʡ100

-

��1298.0

��1398.0

- ����������Y7000 AI�߾� �羺��Ϸ�ʼDZ�����(Ultra7 255HX 16G 1T RTX5060 2.5K 180Hz ��) ���Ҳ���

- ����3000+

-

��8999.0

��8999.0

-

- ��ţIT20 ���������С����ѥ�ӿڻ��������С������������Ӱ���������� ����ɫ��ʿ�桿

- ȯ��ʡ10

-

��214.0

��239.0

- iKF Nano�ռ���Ƶ�桾�����Ƽ�|56dBǿ�����롿ͷ��ʽ���������������������֤�������߶�����

- ȯ��ʡ0.9

-

��413.1

��459.0

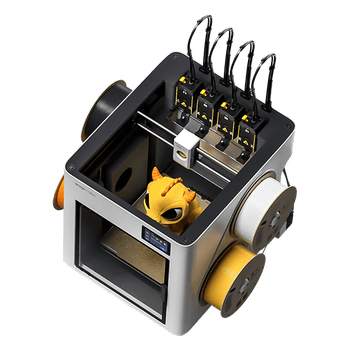

- SNAPMAKER����U1 3D��ӡ������4��ͷ��ɫ����ϸ߾��ȴ�ߴ�AI���ܼ�����������ٴ��ְ�ģ��5��ʡ��

-

��5399.0

��5999.0

- � D610 D750 24-120�� ȫ�������嵥������������۰��ж˵��� �걣����D610+24-85��ͷ �ٷ�����

- ȯ��ʡ220

-

��4772.0

��4992.0

- ����ʼDZ�����С��Pro16GT���ܱ� ���Ultra5 32G 1T 2.8K 120Hz OLED �����ᱡ�칫�� ���Ҳ���

- ȯ��ʡ80

-

��7299.0

��7799.0

����Ԫ

����Ԫ