̫ƽ��Ƽ� ��ҵ

��˹�˿���10���H100���Խ�������ǿAI���㣬��һ��ģ��ѵ����ʼ

����λ

���ϱ༭��̫ƽ��Ƽ�

�����ڣ�2024-07-24 18:22

����λ

���ϱ༭��̫ƽ��Ƽ�

�����ڣ�2024-07-24 18:22

-

������ǿAI��Ⱥ��˹�˽��ɣ���xAI��X��Ӣΰ�����������Ϸ�˹������Ⱥ��Ͷ��ѵ����10���H100��ɣ���ģԶ��Frontier����˹�˱�ʾ���ڽ�����ѵ����ȫ����ǿģ�͡��Խ���Ⱥ���е�����ѡ�����Խ���������ٶ��ƽ�������19�찲װ��ϡ������ͳ���Ϊ�º����̣�������˵�����Ӧ���⡣

|

������ǿAI��Ⱥ����˹�˽����ˣ� ��һ��ը��Ϣ�������������������Թ�����

��һ��ģ��Զ��������ǿ����Frontier�� xAI�Ĵ�ʼ��Ա��������ʾ��

��˹�������£���Ӣΰ���ϵ���С��ó�Һ�似���ij�����Supermicro��Ҳ����ף�ء��䴴ʼ�˲��˹������ʾ��

ͬʱ����˹�˲���˵���ü�Ⱥ�Ľ��ɣ�Ϊ�ڽ�����ѵ����ȫ����ǿģ���ṩ�ش����ơ�

���մ�ǰ˵����ѵ��Grok-3����Ҫ10����H100��

����Ⱥ����ͼ��ֹ�ڴˣ�����6�£������ᵽΪ��H100Ͷ��1GW�����Dz�ֵ���ġ��������죬����ҪͶ��ʹ����30���B200��ɵļ�Ⱥ��

�Խ���Ⱥ���е��� ����5�£�The Information��Ϣ����˹��Ҫ��2025���^ǰ����һ����10��H100��ɵij��㼯Ⱥ������Ľ��к����� ��Ϣ�ƣ�xAI������100����Ԫ�������ü��ĵķ������� ��ʱ���������ɣ�Ϊɶ���꽨�ɵ���Ҫ����һ�������� Ӣΰ���Ѿ��Ƴ��˻���Blackwell�¼ܹ���B100��B200��ѵ����ģ�͵�Ч��Զ��H100�� ���������˵��������Ϣ�е�ʱ����������ǽ�����ɾͺ������ˡ�

�����������˹�˻�Ӧ�˺ͼ�����ֹ�������賬�㼯Ⱥ����Ϣ�� ����ʾ��xAI�Ӽ����õ���24000��H100����Դ����ѵ��Grok-2�������Ϣ֤����xAI�ͼ���֮��ķ��������ú������ڼ����� ������10��H100��Ⱥ�Ľ����ϣ�ѡ�����Խ�ģʽ������������ٶ��ƽ�����˵10���ſ���װ���ֻ����19�졣

֮����Ϣ��ʾ�������ͳ���Ϊ����˹�˵��º����̡� ����CEO����CEO����������ر�ʾ�����ڽ��к��������������������ĵ���Ƭ��

��Ⱥ��������У���˹������ȥ���ֳ��� ͬʱҲ������¶��Grok�����Ϸ�˹ѵ����Grok-2����8���Ƴ���

ֵ��һ����ǣ���ǰ���ĶԼ�Ⱥ��ɵص�ĵ�����Ӧ������ǡ� ���չ��㣬10���H100��Ҫ�ӵ������䵽150���ߵ�����������˹���ƺ��ѽ����һ���⡣ ������Ϣ��ʾ��Ŀǰ��Ⱥ��ʱ�õ���8���ߡ�8��1��ǩ��Э����õ�50���ߡ������Ѿ���32000�鿨���ߣ����ļ��Ƚ�100%���ߡ���������֧��GPT-5��ģģ��ѵ�����С�

��֮���Կ϶����ǣ�AI��ͷ�Ƕ���Ϊ�����������Լ�������ɿ���Ϊ��ֵ�÷����Ǯ�� ���ճɱ����㣬ÿ��H100�ļ۸�ԼΪ3-4����Ԫ����˹�˵ij��㼯Ⱥ����ֵ����40����Ԫ���ۺ�����ҳ�290�ڣ��� ��ǰ��Ϣ�ƣ�����OpenAI�����ƶ�һ����ʴ�1000����Ԫ������������Ŀ��Ϊ���Ǽ�֮�š��� ֪����ʿ¶�����ĺ���֮�����ڴ��һ��ף��漰10���B200����һ��Ⱥ���������������������� ����֮�⣬��MetaҲ���س����������㼯Ⱥ��AWS���Ƴ���Ҳ�����������ϵ�Ͷ����� ������Դ������λ |

ԭ����Ŀ

IT�ٿ�

��������

�۳�ֵ•��ѡ

-

- ������HiVi��M200��ԴHiFi���� ����2.0�������� �ʼDZ�̨ʽ�������� ���ÿ�����������

-

��1079.1

��1199.0

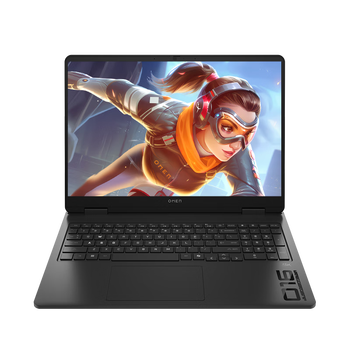

- ���գ�HP��HyperX��Ӱ����PRO 16��Ϸ���ʼDZ�����U7-255HXRTX5060 16G 1T QHD 240Hz ����200W+

-

��12498.0

��12498.0

- Haida�����¿�UV��95mm�˾�NanoPro U-LR 1%������99.9%����52������Ĥ���������������������

- ��100��5

-

��555.0

��615.0

- ���س���APP��֬�ӵ��ӳӳ����سӼ���ר�����ܾ�����������ü���ר�����������ӳ����س� �������APP��֬�� ��� �غ�ֻ�����

- ����1w+

-

��26.99

��27.0

- �� DJI O4 Air Unit ϵ���콢������FPVͼ�� 4K�����֡������ ���ʵ���ʱԶ����ͼ�� ���˻���� DJI O4 Air Unit Pro

- ����1w+

-

��1499.0

��1499.0

-

- JBL��������ͬ�������LIVE780NC����Ӧ���������������� ͷ��ʽ����ʽ �ܱ� ƻ����hoho����6.0 ���ذ���Ʒ��LIVE780NCƻ����

- ȯ��ʡ0.9

-

��1231.0

��1367.8

- ��Ϊ��HUAWEI��FreeClip ���ж��� ����ʽ������������ �����ȹ���� ������ �������� �ǿպ�

-

��799.0

��899.0

- �߲ʺ磨Colorful��ս�� GeForce RTX 5060 Ti ������ 8GB GDDR7 DLSS 4.5 �羺����Ϸ��Ƶ����Կ�

- ����Ʒ

-

��3129.0

��3179.0

- ��ɫ��ESR����ƻ��15W���߳䡿magsafe������������iPhone17promax/16/15/14/13/12/��Ϊ�ֻ������������� ��ƻ��15W���߳䡿�ǿ���حMagsafe����

-

��25.0

��109.0

- ���գ�HP����Ӱ����11��Ϸ���ʼDZ����� ���Ҳ�����R9 8945HX RTX5060 16G 1TBSSD QHD240Hz��

- ȯ��ʡ300

-

��8498.0

��8798.0

-

- ����USB/Type-C3.2���ٶ����� SD/TF3.0˫�����õ���ƽ���ֻ���pocket4/3���˻�ƻ��17�˶����

- ȯ��ʡ0.88

-

��43.91

��49.9

- vivo Pad5 ���� 12GB+256GB չ��ͼ ���Ҳ���15% ����������9300+ 12.1Ӣ����������� ƽ�����

- ����1w+

-

��2649.0

��2849.0

- �����ã�Nintendo�������ڱ�˰�֡�Alarmo���� ��������� 35����������������ϷԪ�� ԭװ�հ�Alarmo���� �ٷ�����

- ȯ��ʡ10

-

��548.0

��598.0

- ��Ϊ��ͯ�ֱ� 5X Pro��Ϊ�ֱ������ֱ����߶�λ�绰������

- ȯ��ʡ100

-

��1298.0

��1398.0

- ����������Y7000 AI�߾� �羺��Ϸ�ʼDZ�����(Ultra7 255HX 16G 1T RTX5060 2.5K 180Hz ��) ���Ҳ���

- ����3000+

-

��8999.0

��8999.0

-

- ��ţIT20 ���������С����ѥ�ӿڻ��������С������������Ӱ���������� ����ɫ��ʿ�桿

- ȯ��ʡ10

-

��214.0

��239.0

- iKF Nano�ռ���Ƶ�桾�����Ƽ�|56dBǿ�����롿ͷ��ʽ���������������������֤�������߶�����

- ȯ��ʡ0.9

-

��413.1

��459.0

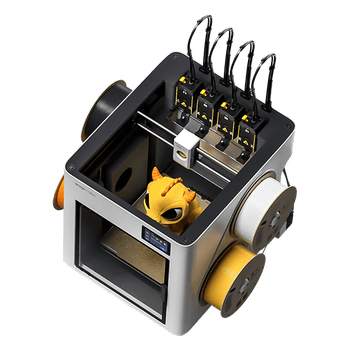

- SNAPMAKER����U1 3D��ӡ������4��ͷ��ɫ����ϸ߾��ȴ�ߴ�AI���ܼ�����������ٴ��ְ�ģ��5��ʡ��

-

��5399.0

��5999.0

- � D610 D750 24-120�� ȫ�������嵥������������۰��ж˵��� �걣����D610+24-85��ͷ �ٷ�����

- ȯ��ʡ220

-

��4772.0

��4992.0

- ����ʼDZ�����С��Pro16GT���ܱ� ���Ultra5 32G 1T 2.8K 120Hz OLED �����ᱡ�칫�� ���Ҳ���

- ȯ��ʡ80

-

��7299.0

��7799.0

����λ

����λ