̫ƽ��Ƽ� ��ҵ

�ٴ���ģ�ͳ嶥���IJ��Ի�����AI���֡���СӦ��ͬʱ���������������

����λ

���ϱ༭��̫ƽ��Ƽ�

�����ڣ�2024-05-26 21:20

����λ

���ϱ༭��̫ƽ��Ƽ�

�����ڣ�2024-05-26 21:20

-

�ٴ����ܷ�������AI���֡���СӦ�������������������ʣ��߱����������Ͷ���������������Ӧ���ǻ�����һ��ģ��Baichuan 4�����ģ�ӵ�ж�ģ̬���������������ۺϲ�����ȡ������ɼ�����СӦ�������Իش��û����⣬�����Ը����Ķ����������Ϻʹ����ȡ�

|

��С��������ʱ�����µ����ӣ��ڴ�ģ��ʱ���ֿ����ˡ� ����ҵ�İٴ����ܣ��ոշ������Լ���AIӦ�ã�to C�ġ���СӦ���� էһ��������Ǹ����´����ŵ�AI���֣����ٷ�ǿ�������AI���ְ���������������������ʽ������ ���˵�������������͡���С�����������ʷŵ�һ���ʱ������������ϸһ̽������ ��СӦ����������ʱ�ش��û�����ĸ������⣬�ٶ��ļ����������ϡ����������ȣ����߱����������������������������ܸ���������������û����� �ٴ����ͣ���ģ������רҵ���������ܣ���Ϊ�˸��û����ṩרҵ���ḻ��֪ʶ����Դ���� ���ң�����֧���û�ͨ���������н�����

�����Թ��ˣ�������ڿ�����iOS�̵ꡢ��Ӧ���г����ٴ����ܹ������ذ�СӦApp������ͨ��Ying.ai��Web�����ʹ���� ����СӦ�����ǰٴ����������������һ��������ģ�ͣ�Baichuan 4������ǰ���������������������µ�����ΰٴ��Ƴ��Ĵ�ģ�;߱���ģ̬������ һ��������������ս���ˣ�����SuperCLUE��ͨ�ô�ģ���ۺ������IJ������������ܵ÷�80.64��ˢ���˹�����¼�������ۺ��������Ը�����1.51�ֵ�������ʤGPT-4-Turbo-0125��

����Baichuan 4����ͬ�����������������ʵ�AI���ְ�СӦ�����滮�ij���ģ�ͺͳ���Ӧ�ø���һ�����ٴ����ܽ���һ�������¸����µ�Ƶ�ʣ�ԭ���DZ��˸����� ��СӦ����ô�ã� ��СӦ���ٴ����ܳ���һ������Ƴ�����AIӦ�á� �ʹ����AI����һ������Ҳ�Ǹ�ͨ�ţ������dz��ı��Ķ����Ƕ�ģ̬���⣬�������߱��Ļ��������� �����������ȸ����һ������һ��������������AI���ֲ�Ʒ���ر�ĵ㣬��СӦ������������������ ��ô�������������ں�Baichuan 4ͨ�������Ͱٴ������������ٴ�չʾ�˰�СӦ��3�ֶ����� һ�ǻ����������� ��һ�����⣬��СӦ�ܾ���λ��������Ȼ��ֱ��Ȩ��վ����ȡ�ص���Ϣ���ḻ����� ����һ�����ٺ�ȷ�� ���������������� ÿһ�����⣬��СӦ���������������������������ⱳ����Ҫ����ʲô��Ȼ���ٸ����ؼ��𰸡� ��ȵ������������г����С���ҵ�����ȸ��ӳ����£����������ܹ���Ч�ػ�ȡ��רҵ��������ȵ���Ϣ��

���ǿ����ṩǶ��ʽ��������� ����˵������������AI�ڵ����������ܽ���ҳ��Ϣ���ļ��ò�ͬ����СӦ�ǽ����������Ϊ�۵㡢�۾�ֱ��Ӧ�õ��ʴ����С� ����Perplexity���֣����ܽ����������������Ϊ�Ǹ�����Ӧ��������2.0Ҫ���Ĺ������������湫˾�Լ����ܸɣ���������Ҫ���ġ���

ͬʱ�����ʱ����СӦ�ȽϽ����ṹ������� Ҳ���ǽ��ؼ���Ϣ������+�������ʽ���������ûش���������ص�һĿ��Ȼ��

���֡�����Ƕ�������ȼ����ӳ֣��õ��Ľ�����ǰ�СӦ�������� �Ŷ���ȷ�˽⣬ģ��+�����������ں�ȷʵ��������ģ�ͻش��ȷ�ԡ����ͻþ�����ֻ�м����Dz����ģ���Ҫ��Ʒ����������Ľ�������� ����������ij����й���˵�������������ĺô����������AI����ش��ȷ�ԡ�ʱЧ�ԣ����ͻþ���Ҳ�����ӻش��еĹ۵㡢���������ݵȣ�ʹģ�͵Ļش���ḻ�����ʻ

˵���СӦ������������˵˵������������ô������� ��רҵ��ʾ�ʹ���ʦ��һ���AI�Ի�ʱ�������������Ƚ���ͳ�������ر�ȷ�� ��СӦ�����ʾ����������������ģ����û�����Ļ����ϣ�ͨ������һ���������������û�������������������

������Щ��СӦ��Ʒ��������˼���ͼ���ʵ�ֶ���Ϊ�˽�����ͨ��ʹ��AI���ֵ��ż�������ͨ�û���˵���Ǻ��Ѻõġ� ��Ȼ�ˣ�˵������Ϊ��������һ���û������õ��ϵĴ𰸡� ǰ���ᵽ����СӦ�Գ��ı��Ķ��Ͷ�ģ̬����Ҳ�ǵ���Ӧ�֣�����ż���showcase�����Ҳ�����Լ���������һ�£������bug����ֱ�Ǵ�ģ��ʱ��������ϲ���ּ����¶��ˣ��� ��ģ̬������������Ƚ�nice���������İ������ͷ��Ҳ�ܾ�ʶ�����

���ı��������������Ʊ�Ҳ˳�����أ�

һͨ�����������о��ճ��Ի����칫������������֪����ģ̬ʶ�𡭡���СӦ�Ŀ�Ӧ�ó�������ͦ��ġ� ���ٴ����ܴ�ʼ�˼�CEO����������������ǰ�ᵽ�����Ƴ��ij���Ӧ���� ���ֽ��г��ϣ���û�г���ģ�ͣ�Ҳû�г���Ӧ�á��� �����Ļ�˵����СӦĿǰ�Ǹ�AI���֣��Ǵ�ģ��ʱ�����û������Ӧ�ôӡ����ߡ���������顱���м�̬�� �������̣�����չ���������û�����Ĺ��̡�

����ģ��Baichuan 4��ս�Ƕ� ��ͷ�۾��ᵽ������СӦ�����ǰٴ������Ƴ���Baichuanϵ��ģ�����°汾Baichuan 4�� Ҳ�ǰٴ�������ִ�ģ�������Ƴ��ĵ�һ���ģ̬ģ�͡� ���ǰ������ģ��Baichuan 3������1�µ�������Baichuan 4�ڸ��������ϵ�������ͦ���ԡ� ����ָ���������20%����Ϣ��������9%��֪ʶ�ʴ�����15%����������16%������������15%��ר���������棬��ѧ����14%����������9%�� ��ս��ݣ���OpenAI���ڰ��SuperCLUE�ۺϻ��ϣ�Baichuan 4һ���־������˵�һ�� �ܵ÷�80.64�֣�����ǰһ����һ��ģ��0.61�֡� �������ʤ���� Ȼ���ֲ���С����������֪�ڴ�ģ��ʱ��������0.01��Ҳ�Ե��������

��ô�������أ� ѵ�������У�Baichuan 4����ļ����Ż��ֶΣ���������model-based+human-based��Эͬ����ɸѡ�Ż����Գ��ı���ģλ�ñ����ѧ��Scaling-law����Ч������ģ�Ͷ����ݵ����á� ��������Ŷ��ص��Ż�Baichuan 4ģ��Reasoning��Planning��Instruct Following������ͨ��Loss����������ѡȡ��ѵ����������£���ģ�Ͳ����ںϵȷ�ʽ�� ������ˣ��Ŷ�����һ�λ������Sequential Preference Optimization��SPO��������ͨ��˳����LLMs��������ƫ�õĶ��ά�ȱ���һ�£��ؼ�ָ���ģ���ȶ��Եõ����������� ͬʱͻ��RLHF��RLAIF�ںϵ�RLxFǿ��ѧϰ���뼼�����������ģ�͵�ָ����ѭ�������� ���⣬Baichuan 4���߱���ҵ���ȵ���ģ̬��������MMMU��MMBench-EN��CMMMU��MMBench-CN��MathVista��������ϱ������죬����Gemini Pro��Claude3-Sonnet�ȶ�ģ̬ģ�͡�

���������Baichuan 4��û�߿�Դ·���� ��С���Դ������˻�Ӧ����ȥ��������������Դ���ǰٴ��Ŷ���ִ�ģ�͵�Ͷ��״����ʱ���ڿ�Դ�����dz������졣��������Դ����£�Ҳ�Թ��ڿ�Դ��ҵ��������Ҫ���ף����ڿ�Դ�����Ѿ��кܶ�����ھ����ˡ��� �����ǣ�Ҫ�����г��ĵ��ڻ��ư�������С��˵�� Baichuan 4��Դ�ˣ���API��Ӧ���ɡ� ��һ������ģ�Ͷ���ź�һ���������Ŀ�ģ��API���ֱ���Baichuan 4��Baichuan3-Turbo��Baichuan3-Turbo-128k��Assistant API�� ͬʱҲ���콢���רҵ�����콢��ȫ������Baichuan 4�ĸ���������רҵ����ΪBaichuan3-Turbo���۸���콢��ʵ�ݣ����ܱ�Baichuan 2���ã��������ҵ�ĸ�ƵӦ�ó�������������Ż��� ��Ȥ���ǣ���ȻAssistant APIҲֱ�ӿ��Ÿ���ҵ�û�������ã�����Խ����Ȼ���Ĵ�ģ�ͼ۸�ս���ٴ���̬�Ⱥ���ȷ�� ʲô���۸�ս������˹���

һ������С����ȷ�Լ���Ҫ�dz�to C���뷹�ģ��Ƴ��̵ļ۸�ս���ٴ�ûɶӰ�졣 �������������ᶨ����Ϊδ���϶���������������̫���ˣ������й��г���API������ʵ�Դ�ҵ��˾���߲�ͨ�ġ��� ��С����һ�������Լ��Ĺ۵㣺 �����ֻ�Ǵ���ҵ�Ƕ������Ļ����й���ǰ����ҵ��������To B��To C��ű�����С��10�������������й�B���г�����������Dz����ڵģ� ��Σ���������ʱ�ᷢ�֣��������յ�������ң�����������ȴ����Ԫ������ʵ����һ������API�����г��ľ����𡣡� ���ڰٴ����ܶ��ԣ��ڲ�һ����Ϊһ��Ҫ���в��컯�������� ��ֻ�Ǿ��۸�Ļ�������ͷ����ҵ��˾�ߵͼ���һ�����ƣ�������۸�;ͱ�ɾ������Ļ������г���������ʵ�Dz����ġ��� Ϊʲô��to C��Ʒ�������� ȥ�꣬��С�����ȶ�������ԣ���ʾ2024���п��ܻᵮ�����ɴ�ģ�ͳ���Ӧ�á� ��������Ļ���������Ǵ�����������ҵ�У����ٴ�ģ�ʹ�ҵ��˾ȷʵ�����to C�˳����ˡ� ���ڼ۸�ս�ϲ��Ų�æ�İٴ����ܣ����Ƴ�Ӧ����飬Ҳ���ֳ�һ������ͼ֮����̬�� ��С��һЦ��˵�����Ҳ����ð�СӦ���������෴���Ҿ��÷�����������Ϊģ��Ӧ�û���Ҫ����ʱ��Ĵ�ĥ���� ����ʾ��ģ��Ӧ�ð���DAU����ԶԶ�����ϡ�����Ӧ�á��ijƺš����֮ǰ����Ӧ�ã������Ƕ��Լ�ģ�ͽ���չʾ�������ڣ��û�������֪����ЩӦ���ڸ�ɶ�ˡ� ��������ҵ���ڶ���û�������״̬��֮ǰ�����뷨�����������桢���������������̵�֪��һ��Ӧ�õ�ʲô����ʱ���DZ��һ���㷺��ʹ�õIJ�Ʒ�������ʱ�������� ���ԣ���СӦ�����ʱ������ν�������������ǰٴ��������˸��������������ҵ����Ŷӿ��Ը�����ذ�����ת������

������Ӧ��֮ǰ���ٴ����ܰѰ�СӦ��DzΪ��һλ��ս���������ĵ�սʿ��Ҳ���Լ��ĵ����� �������ᵽ�ģ��ٴ�������Ϊ����ͬ����Ϣʱ���������ԵIJ�Ʒ����ģ�ʹ�������������� ��AI�ӹ��߱�Ϊ��飬���ڴ�ģ�ʹ���AI���ָ������ڡ����ˡ��� �������ܹ�ʹ�ù��ߡ���˼�����������ܶ����ῴ����д��һ����AI�������Ʒ����ģ�������ij���������ҲӦ�þ߱���Ӧ�������� ������Ϊ���´�ģ������Ҫ�Ĺ��ߣ��������ô�ģ��ʵʱ��ȡ������Ϣ��������Ч�����ģ�͵Ļþ����⣬�Ǵ�ģ�͵Ĺؼ�����֮һ��Ҳ�ǰٴ����ܵ��ص�̽������ȥ�귢��Baichuan-53B��ʱ���ŶӾ��Ѿ������������ǿ�����RAG����Ҳһֱ���ڵ�һ�ݶӡ�

�����������ٴ�ѡ���˶�������AI��������Ϊ�Ŷ���to C��������ĵ�һǹ�� ���ԣ���СӦ���ϵIJ��컯�İٴ�ζ�����dz�һĿ��Ȼ���� AI����м�̬+Baichuanģ������+�ѹ��������׳���+������Ʒ������ۡ�

������Ӧ��������δ����ʲô����С��dzdz¶��һ������ Ը����Ȼ�dz���ģ�ͺͳ���Ӧ�ã��ÿɿ�����һ����Ҫ����������ϡ� ͻ�Ƶ�Ӧ������AI��ÿ������ҵ��ְҵ��ʿ�������ְҵ��������ܶȡ�˼ά�ȼӽ�ȥ�������㹻���á� ��һ���ĸ�����������٣���С�����˸����ӣ��������������Dz�˵�� �����������Ĺ�ͨ���ڣ�������ԼԼ��¶���������� ���ᵽ��ΪʲôҪ��AI���ֻ����ʣ�һ��ԭ����Ϊ���պ�ij���Ӧ�������ۣ��ٵ����Ӿ��ǡ���ȥ����˵�ҷ����ˣ�AIֱ�Ӹ���һ�������һ���Dz����е���� �����ᵽͼ�齱����ߡ�Ilya����ʦGeoffrey Hinton������ܵIJɷã���ү�ӳ�ҽ�Ʊ���������ǰ;��AIӦ�������������Ҷ�ȥ��������ɷã��� ҽ�ƣ��ţ����˼·��Ȼ����С���� ���������������������Ű�СӦ�����һ����ɡ��� ������Դ������λ |

ԭ����Ŀ

IT�ٿ�

��������

�۳�ֵ•��ѡ

-

- Canon����r100���ż������ ���м���ѧ��vlog��Ƶ���� 4kС�ɱ�Я�뻭��������� R100 18-45�� ������� �ٷ����䡾�����ڴ濨��� �Ƽ������ײ͡�

-

��3299.0

��3599.0

- SANCʢɫ27Ӣ��2K240Hz 1152����MiniLED�羺��ʾ�� QD���ӵ��ɫ�� HDR1000nit���� ������ĻS73mPro

- ����3000+

-

��1049.0

��1099.0

- Ӱ��GeForce RTX 5060 ħ��V2 OC Ӣΰ���Կ�

-

��2898.0

��2898.0

- ��ɫ��ESR����ƻ��15W���߳䡿magsafe������������iPhone17promax/16/15/14/13/12/��Ϊ�ֻ������������� ��ƻ��15W���߳䡿�ǿ���حMagsafe����

-

��25.0

��109.0

- ����thermalright���650W TR-TG650 ����ȫģ�� ȫ��ϵ������ 14CMС���� ATX3.0��Դ 80PLUS������֤

- ����Ʒ

-

��259.0

��279.0

-

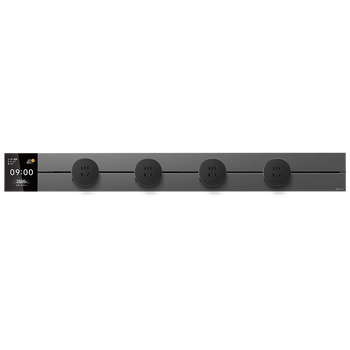

- ���ֹٷ���Ʒ�¿�AI������������wifi�ƶ�����wifi6��������AI����ѡ��wifi���ض����л�·���� AI�������ܸ߽װ�����wifi-��ɫ

- ȯ��ʡ10

-

��37.8

��47.8

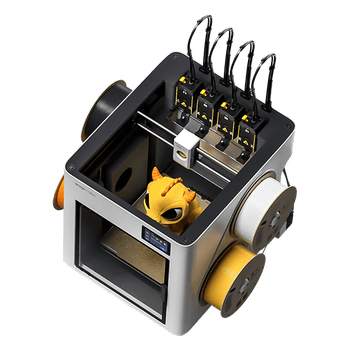

- SNAPMAKER����U1 3D��ӡ������4��ͷ��ɫ����ϸ߾��ȴ�ߴ�AI���ܼ�����������ٴ��ְ�ģ��5��ʡ��

-

��5399.0

��5999.0

- ���ϣ�SanDisk��2TB Type-c USB3.2�ƶ���̬Ӳ�̣�PSSD��E30���� �ƶ�SSD ����800MB/s �����ֻ��ʼDZ�����

- ����1000+

-

��1299.0

��1299.0

- ��������2026�¿��ֳ�С���ȡ��������ȱ�Яʽusb������㾲�������������˯�߽�����������С�͵��� ������+���� ��ɫ 3600mAh ��������ح��������

- ȯ��ʡ0.88

-

��77.44

��88.0

- ����������Y7000 AI�߾� �羺��Ϸ�ʼDZ�����(Ultra7 255HX 16G 1T RTX5060 2.5K 180Hz ��) ���Ҳ���

- ����3000+

-

��8999.0

��8999.0

-

- ���������èС����������Я�ֳ�С�����������usb��������Ȱ칫�����ṤλС�͵���ȹҲ������������ ��è�ն�̨ʽ���� ������������

- ȯ��ʡ19

-

��29.8

��48.8

- OPPO Find X9 Ultra 12GB+256GB ���ر��� 10��������۳��� ������ ��Ϸ 5G ������Ӱ�콢�ֻ��»�

- ����1w+

-

��7499.0

��7499.0

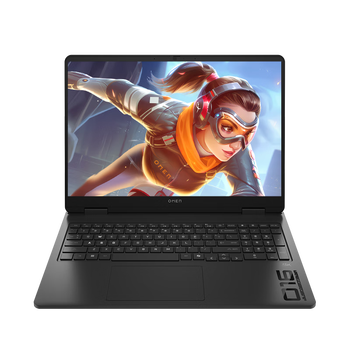

- ���գ�HP����Ӱ����11��Ϸ���ʼDZ����� ���Ҳ�����R9 8945HX RTX5060 16G 1TBSSD QHD240Hz��

- ȯ��ʡ300

-

��8498.0

��8798.0

- С���������������4˫��� ����500��+500����������ͷ�������ܼ������wifi ũ�� ���� ͥԺ

- ����1000+

-

��274.0

��299.0

- ����240����������û�Ϊ�����Mate60pro�ֻ����ͷ�����ͷmate50pro/30/40������ҫnova8/9������ 1.0��6A�����

- ��2��9��

-

��3.99

��4.0

-

- ���65Ӣ�����ƽ��һ�������ƽ�崥����һ�����ý���ѧһ���������ʾ���Ӱװ�������E65��װ

-

��4759.0

��4759.0

- ��ǿ�����2026���¿�حȫ����������������������ʽ�ǹǴ�������ʽ�������߲�����˶��ܲ���Ϸͨ������ �ѿպڡ�����Ultra��ح������ô����ʡ� �ű�ȫ����ح��������ح����ͨ��

- ��157��41

-

��58.8

��157.8

- ������deli���ܷ��a4 ���ð칫С����Ƭ���ܻ����ܹ���ѹĤ��Ĥ��Ĥ�� �����ܷ�Ĥa4�����»���Ĥ�ܷ�ֽ GQ403

-

��74.9

��74.9

- ��ţ��BULL����ʦ�������Թ���������ƶ����߰���ʽ���Ųͱ߹ز������ ����+APP����gb3z 75cm+4�����

-

��769.03

��769.0

- �������ӣ�HIKVISION��ȫ����˷� 360������ 3��ʰ���뾶 ��Ƶ������˷� USB���弴�������� ������ר��300U(Pro)

- ȯ��ʡ25

-

��335.0

��360.0

����λ

����λ