̫ƽ��Ƽ� ��ҵ

��ģ�Ͳ����ǡ���ߡ�������������ô�ó��ı���

AI��ѡ��

���ϱ༭��������

�����ڣ�2024-04-01 17:11

AI��ѡ��

���ϱ༭��������

�����ڣ�2024-04-01 17:11

-

��Kimi����ɱ���֮��ģ�ͶԻ���Ʒ����������˳��ı����ܶ��˲��Ͳ����ˣ���˵������Ҳ���Ѱ��������������С��ⲻ��������������������ͨ��ǧ��֧��2000���������ģ�360AI����������Լ�֧��200���������ģ��ٶȵ�����һ��Ҳͬʱ�������Լ�֧��500���������ġ�KimichatҲͬ���������ڲ��Լ�֧��200���������ġ�Ŀǰ����Jamba�Գ��ı��Ĵ���Ч����������GPU����֧��140K�����ġ�Claude 3Ҳ��ChatGPT 4Ч���á����ı������Ѳ��ѣ���ôһҹ֮��ǧ�������滨����

|

��Kimi����ɱ���֮��ģ�ͶԻ���Ʒ����������˳��ı���

�ܶ��˲��Ͳ����ˣ���˵������Ҳ���Ѱ��������������С� �ⲻ��������������������ͨ��ǧ��֧��2000���������ģ�360AI����������Լ�֧��200���������ģ��ٶȵ�����һ��Ҳͬʱ�������Լ�֧��500���������ġ�KimichatҲͬ���������ڲ��Լ�֧��200���������ġ� Ŀǰ����Jamba�Գ��ı��Ĵ���Ч����������GPU����֧��140K�����ġ�Claude 3Ҳ��ChatGPT 4Ч���á�

���ı������Ѳ��ѣ���ôһҹ֮��ǧ�������滨�����Ѳ��ѣ�����ŵ������㼼��������ǰ��������˵��ģ�͵ij��ı���ʲô�ã�Ȼ��ֱ�Ӳ����ڼ��ҳ��ı���Ч���� ��ͨ�˵�һ����ع��������� ���ںܶ����ô�ģ�ͣ�д�����İ���д���Ÿ塢дС˵�����dz���������

�������ı�����ܶ�������ͱȽ������ˡ� ���紦���ܶ�Ʊ����ݣ��ϴ����Զ���������˲����Dz���ר�ң� �����Ķ�������Щ�¶�����ʷ�ĵ�˲�������������“����”��������; �����ϴ���ҵ�о����棬��ҵ������ݽ����������ϱ����ҵ�о�ר�ң� ��Щ���ݣ���������������������Ĺؼ��ִ𰸣������ڻ��ͨ��������������ʻش� ������һ������������Translink Capital�ٰ��2024��AI����ϣ�Ͷ����Kelvin Mu ����87ҳAI��ҵ��������ݱ����Ǵ�Ӣ�ĵģ�ͼƬ�Ƚ϶࣬�����ݱȽϾ��ʣ�AI��ҵ���˶�Ӧ�ö�һ�¡� �����������ż�������ʱ��������������������kimi������������ĵ��Ľ�����Kimi��ֱ�ӷ��룬���ҹ��������ݣ��Dz��ǻ�ͦ���á�

ʹ��Ч�������� �����µ����Ŀǰ����ı����Ȿ���л�����ȫ������һ����100���֣����ݻ��������ģ��������ս�ԣ������ˡ� Ŀǰ�����Ѿ��õ���Kimichat��200���������IJ����ʸ��ϴ��Ȿ������ʵĵ�һ��������һ����������ʲô��˼��

�������ش�IJ����������������ĵ�������û��������顣�ðɣ�����Kimi�������ش�������һ���⡣ �����������ĵ��е�һ�仰��Ҫ��kimi�����ҳ���һ�䣬��������ѶȲ�����ֵ���Kimi����2�ζ�û��ԣ�������ϴ��ˡ�

���ڲ���ͨ��ǧ�ʵ�ʱ�����ĵ�������ʱ��

���������ϴ�Translink Capital�ٰ��2024��AI���PPT�����벢�ܽ����ĵ����ݡ�

�Աȿ����Ҹ��˾���kimi���ܽ��һЩ�����ݵ���������ݾ������棬��չ�ֵıȽ�ϸ�¡� 360������ƪ�ĵ�ʱ������ʾ���ܴ���word��PPT��What��PDF�DZ�word�������ĸ�ʽ�� ���罫PPT��360AI���������ǰ���ᵽ��Translink Capital2024��AI���PPT�����PPT ת��PDF���ϴ���360���Է�������ͼ���Կ����ܽ�����ֺ�˼ά��ͼ���С�

360AI������ڴ����ĵ����棬��Ʒ�����IJ��������з��빦�ܣ���ҳ���շ��룬���WPS�ĸ��ѷ��뻹���á�

����һ���ǻ���Chatfile�ṩ���ĵ����������������ϴ�����10M���ĵ������л����ء�Ҳ�����˸���С��Translink Capital 2024��AI���PPTҲ��������һ��Χ�� Ҫ֪���ܶ�PDF��������10M������һ�Ի���Ҫ�����ϴ��ĵ���С�����ơ� ������������ij��ı����������������ٶ��ü��ϵ����ƶ�� �Ⲩ���ı��������¸��� ����������Ÿ��ܲã������о�Ժִ��Ժ�������������ܾ�����Դ˵���� Kimi��֧��200�������ģ����ϳ���һ��ͨ��ǧ��֧��1000�������ġ����Ƕ�û��needle-in-haystack�������ݡ�û��needle-in-haystack���Ե������ľ���ˣ��å����ʵ���Ǹ�RAG���ѡ� needle-in-haystack�Ǵ��������˼��RAG�Ǽ�����ǿ����(Retrieval Augmented Generation, RAG)����˼����ͨ��������Դ�м�����Ϣ������������ģ��(Large Language Model, LLM)���ɴ𰸡� ��ģ���ڴ�����������ʱ�������������������ݣ�Long Context����ͻ�ƻ����е��Ѷȡ���ʱ��RAG�ͳ�Ϊ������ģ�Ͳ��̰��һ�������ֶΣ��ɱ��ͣ�Ч������������Ȼ���������Ĵ�ģ�ͼ���ͻ�ƣ������������ݿ��һ���������� ��Ŀǰ����Long Context�����������Ѿ�ȡ����һ����RAG�ij�����������ģ��������ֻ��4K��ʱ��80K���ĵ�����Ҫ��RAG������������������Claude 3 Haiku��200K�����ģ�һ���Խ���� ��Ȼ��RAG�����ߣ�20MҲ�������������Ժܶ���ҵ˲���������������Ĵ�����������û��ˮ���ء���ʵ�Ӹ��������ܲ��ܻش𣬻ش�Ľ���ò��ã����ֱܷ������ ��ҿ��Զ����������ı�������������ȹ�ȥ�������ؼ��֣��ܶ�����϶����Դ������������� ������Դ��AI��ѡ��

|

ԭ����Ŀ

IT�ٿ�

��������

�۳�ֵ•��ѡ

-

- Canon����r100���ż������ ���м���ѧ��vlog��Ƶ���� 4kС�ɱ�Я�뻭��������� R100 18-45�� ������� �ٷ����䡾�����ڴ濨��� �Ƽ������ײ͡�

-

��3299.0

��3599.0

- SANCʢɫ27Ӣ��2K240Hz 1152����MiniLED�羺��ʾ�� QD���ӵ��ɫ�� HDR1000nit���� ������ĻS73mPro

- ����3000+

-

��1049.0

��1099.0

- Ӱ��GeForce RTX 5060 ħ��V2 OC Ӣΰ���Կ�

-

��2898.0

��2898.0

- ��ɫ��ESR����ƻ��15W���߳䡿magsafe������������iPhone17promax/16/15/14/13/12/��Ϊ�ֻ������������� ��ƻ��15W���߳䡿�ǿ���حMagsafe����

-

��25.0

��109.0

- ����thermalright���650W TR-TG650 ����ȫģ�� ȫ��ϵ������ 14CMС���� ATX3.0��Դ 80PLUS������֤

- ����Ʒ

-

��259.0

��279.0

-

- ���ֹٷ���Ʒ�¿�AI������������wifi�ƶ�����wifi6��������AI����ѡ��wifi���ض����л�·���� AI�������ܸ߽װ�����wifi-��ɫ

- ȯ��ʡ10

-

��37.8

��47.8

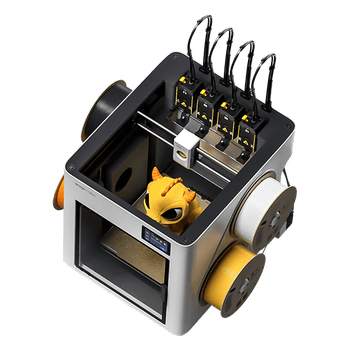

- SNAPMAKER����U1 3D��ӡ������4��ͷ��ɫ����ϸ߾��ȴ�ߴ�AI���ܼ�����������ٴ��ְ�ģ��5��ʡ��

-

��5399.0

��5999.0

- ���ϣ�SanDisk��2TB Type-c USB3.2�ƶ���̬Ӳ�̣�PSSD��E30���� �ƶ�SSD ����800MB/s �����ֻ��ʼDZ�����

- ����1000+

-

��1299.0

��1299.0

- ��������2026�¿��ֳ�С���ȡ��������ȱ�Яʽusb������㾲�������������˯�߽�����������С�͵��� ������+���� ��ɫ 3600mAh ��������ح��������

- ȯ��ʡ0.88

-

��77.44

��88.0

- ����������Y7000 AI�߾� �羺��Ϸ�ʼDZ�����(Ultra7 255HX 16G 1T RTX5060 2.5K 180Hz ��) ���Ҳ���

- ����3000+

-

��8999.0

��8999.0

-

- ���������èС����������Я�ֳ�С�����������usb��������Ȱ칫�����ṤλС�͵���ȹҲ������������ ��è�ն�̨ʽ���� ������������

- ȯ��ʡ19

-

��29.8

��48.8

- OPPO Find X9 Ultra 12GB+256GB ���ر��� 10��������۳��� ������ ��Ϸ 5G ������Ӱ�콢�ֻ��»�

- ����1w+

-

��7499.0

��7499.0

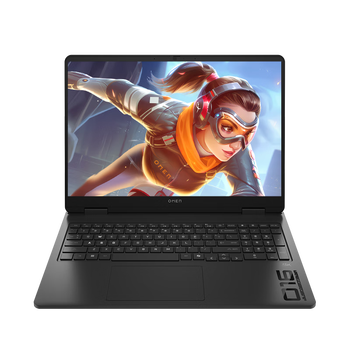

- ���գ�HP����Ӱ����11��Ϸ���ʼDZ����� ���Ҳ�����R9 8945HX RTX5060 16G 1TBSSD QHD240Hz��

- ȯ��ʡ300

-

��8498.0

��8798.0

- С���������������4˫��� ����500��+500����������ͷ�������ܼ������wifi ũ�� ���� ͥԺ

- ����1000+

-

��274.0

��299.0

- ����240����������û�Ϊ�����Mate60pro�ֻ����ͷ�����ͷmate50pro/30/40������ҫnova8/9������ 1.0��6A�����

- ��2��9��

-

��3.99

��4.0

-

- ���65Ӣ�����ƽ��һ�������ƽ�崥����һ�����ý���ѧһ���������ʾ���Ӱװ�������E65��װ

-

��4759.0

��4759.0

- ��ǿ�����2026���¿�حȫ����������������������ʽ�ǹǴ�������ʽ�������߲�����˶��ܲ���Ϸͨ������ �ѿպڡ�����Ultra��ح������ô����ʡ� �ű�ȫ����ح��������ح����ͨ��

- ��157��41

-

��58.8

��157.8

- ������deli���ܷ��a4 ���ð칫С����Ƭ���ܻ����ܹ���ѹĤ��Ĥ��Ĥ�� �����ܷ�Ĥa4�����»���Ĥ�ܷ�ֽ GQ403

-

��74.9

��74.9

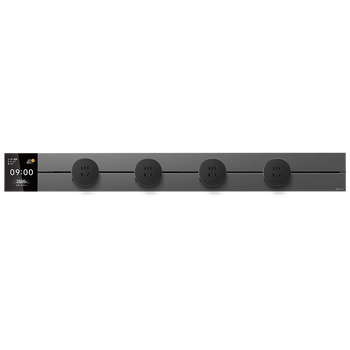

- ��ţ��BULL����ʦ�������Թ���������ƶ����߰���ʽ���Ųͱ߹ز������ ����+APP����gb3z 75cm+4�����

-

��769.03

��769.0

- �������ӣ�HIKVISION��ȫ����˷� 360������ 3��ʰ���뾶 ��Ƶ������˷� USB���弴�������� ������ר��300U(Pro)

- ȯ��ʡ25

-

��335.0

��360.0

AI��ѡ��

AI��ѡ��