Ì«ÆœŃóżÆŒŒ ĐĐÒ”

žűChatGPTĐĄ·ŃŐæ”ÄșĂÊ裥10żé»ò10ÍòЧčû°ÎÈșŁŹ”«žű1Ă«Č»Éę·Žœ”

ÁżŚÓλ

ŐûșÏ±àŒŁș»Æ°ČÀò

·ąČŒÓÚŁș2024-02-03 22:55

ÁżŚÓλ

ŐûșÏ±àŒŁș»Æ°ČÀò

·ąČŒÓÚŁș2024-02-03 22:55

-

»čÓĐËČ»ÖȘ”ÀĄ°ŒÙŚ°Ą±žűChatGPTĐĄ·ŃżÉÒÔÈĂËü·țÎńžüÂôÁŠŁżŽÓ0.1ĂÀÔȘ”œ100ĂÀÔȘŁŹČ»ÍŹ¶î¶ÈÓĂÍŹŃù”ÄpromptÈ„łąÊÔŁŹĂżžö¶î¶ÈÊÔ5ŽÎĄŁ

|

»čÓĐËČ»ÖȘ”À“ŒÙŚ°”žűChatGPTĐĄ·ŃżÉÒÔÈĂËü·țÎńžüÂôÁŠŁż

”«ÄăÖȘ”Àžű¶àÉÙŚîșÏÊÊÂ𣿠ЊȻ»îÁËŁŹ»čŐæÓĐÈËŚšĂĆŃĐŸżÁËÒ»·ŹĄŁ ·œ·šŒò”„ŽÖ±©ŁŹŽÓ0.1ĂÀÔȘ”œ100ĂÀÔȘŁŹČ»ÍŹ¶î¶ÈÓĂÍŹŃù”ÄpromptÈ„łąÊÔŁŹĂżžö¶î¶ÈÊÔ5ŽÎĄŁ Äă±đË”ŁŹœáčû»čŐæÓĐœČŸżŁș ÊŚÏÈŁŹžű10ĂÀÔȘĐԌ۱ÈÊÇŚîžß”ÄŁŹÉőÖÁłŹčę100ĂÀÔȘĄŁ

ÆäŽÎŁŹÒȘÏë»ŰŽđÖÊÁżÔÙÌážßÒ»žö¶ÈŁŹŽò”Ś1ÍòĂÀÔȘÆđŁŹÔœ¶àÔœșĂŁŹÏÔłÉЧŚîÉÙ10žöW°ÉĄŁ ŚîșóŁŹ0.1ĂÀÔȘÒâˌһÏÂŁżÍòÍòÊčČ»”ĂŁŹÖÊÁżČ»Éę·Žœ”ŁŹ»čČ»ÈçČ»žű——AIÒČÖȘ”ÀÄăÔÚŽò·ąËü

ÓĐÍűÓŃ»đËÙÇŚČâÈ·Ê”ÓĐЧčûĄŁ

žÏœôÀŽÇÆÇÆĄŁ žűChatGPTĐĄ·ŃŁŹ¶î¶ÈÊÇčŰŒü

žűĐĄ·ŃżÉÌážßÄŁĐͱíÏÖŐâŒțÊÂŁŹŚîÔçÊÇһλÍÆÌŰÍűÓŃ·ąÏ֔ģș

ÌážßÖśÒȘ±íÏÖÔڻێđ”Äł€¶ÈÉÏŁŹ”«ŐâÀïČ»ÊÇ”„Žż“ŽŐŚÖÊꔶűÊÇŐæ”ÄÔÚžüÏêÏž”Ű·ÖÎöČą»ŰŽđÎÊÌ⥣ ÈçčûÄăÖ±œÓÎÊChatGPT“ÄÜČ»ÄÜžűÄăĐĄ·Ń”»á±»ŸÜŸűŁș

ËùÒÔÒȘÔÚÌáÎÊÊ±Öś¶ŻłĐĆ”Łș ÄăÄÜ°ïÎÒxxxxÂđŁżœâŸö·œ°žč»ÍêĂÀŁŹÎÒżÉÒÔÖ§ž¶xxÔȘĐĄ·ŃĄŁ ŒÇŚĄŁŹżÉÒÔČ»Ìᣏ”«Ç§ÍòČ»ÒȘË”“ÎÒČ»žű”ŁŹÄŁĐͱíÏÖÖ±œÓ“žșÔöł€”ĄŁ

ŐâʱŁŹŸÍÓĐÈËșĂÆæÁËŁș ŽóÄŁĐÍÊÇČ»ÊDZȜÏÌ°ĐÄŁŹžűÔœ¶à±íÏÖŸÍÔœșĂÄŰŁż ÎȘÁËœâŸöŐâžöÒÉÎÊŁŹËûĂÇŸö¶šÇŚŚÔŃéÖ€Ò»°ŃĄŁ ÔÚŽËŁŹŚśŐßÊŚÏÈÌáłöŒÙÉèŁș ËæŚĆžűłö”ÄĐĄ·Ńœđ¶îÔöŒÓŁŹÄŁĐÍ”ÄĐÔÄÜÒČ»áÏßĐÔÌáÉ꣏ֱÖÁŽï”œÒ»žöÊŐÁȔ㣏œűÈëÎȶš»òŒőÉÙŚŽÌŹĄŁ ÓĂÓÚÊ”Ńé”ÄÄŁĐÍÊÇGPT-4 TurboŁšapi°æ±ŸŁ©ĄŁ ·œ·šÊÇÈĂËüĐŽ”„ĐĐPythonŽúÂ룚Python One-LinerŁ©ŁŹŃéÖ€žűȻ͏Х·ŃÊÇ·ń¶ÔÖÊÁżÓĐȻ͏ӰÏìĄŁ ŐâÀï”ÄÖÊÁżÊÇžùŸĘ”„ĐĐÊęÁżÀŽÆÀčÀ”ÄĄŁŚśŐßÒČÔÚÌáÊŸŽÊÖĐ“ĂśÊŸ”ÁËÄŁĐÍŁș”„ĐĐŽúÂëÊęÁżÔœ¶àŁŹ±íĂśĐÔÄÜÔœșĂĄŁ È»șóÒ»čČČâÊÔ8ÖÖ¶î¶ÈŁș0.1ĂÀÔȘĄą1ĂÀÔȘĄą10ĂÀÔȘ…… Ò»Ö±”œ100ÍòĂÀÔȘĄŁ

ÎȘÈ·±Łœáčû”ÄÒ»ÖÂĐÔșͿɿżĐÔŁŹĂżžö¶î¶È¶ŒČâÊÔ5ŽÎŁŹĂżŽÎ°üșŹČ»žűĐĄ·Ń”ÄÇéżöŁŹÈ»șó·Ö±đŒÇÂŒÄŁĐͻێđÖÊÁżĄŁ ŸßÌć¶űŃÔŁŹÒČŸÍÊÇŒÇÂŒÉúłÉ”ÄÓĐЧŽúÂëĐĐÊęÒÔŒ°»ŰŽđÖДĎóÖÂtokenÊ꣚ŽóÖÂÎȘÏìÓŠł€¶È/4ŁŹ·ŽÓŠŽúÂëÁżŁ©ĄŁ ŐâÁ©ÊęŸĘ¶ŒÊÇÔœžßŽú±íÄŁĐͱíÏÖÔœșĂĄŁ œ«œáčû»ăŚÜŁŹŸÍ”Ă”œŐâŃùÒ»ŐĆÍŒŁș

ÆäÖĐĐéÏߎú±í»ùÏßËźÆœŁŹÊ”ÏßÎȘÊ”ŒÊ±íÏÖŁŹșìÉ«ÎȘtokenÊꥹÀ¶É«ÎȘÖÊÁż”Ă·ÖĄŁ ÓëŒÙÉèÓĐĐ©łöÈëŁș ŐûÌćÀŽżŽŁŹșìÏßșÍÀ¶Ï߶ŒÊÇËæŚĆĐĄ·Ń¶î¶È”ÄÉÏŐǶűÉÏÉę”ÄŁŹ”«ÏžżŽŐâÖÖÇśÊÆČą·ÇŃÏžńÒ»ÖÂĄŁ ŽÓ1ÍòĂÀÔȘ¶î¶ÈżȘÊŒŁŹÄŁĐÍ”ÄÊäłötokenŁšŽúÂëÁżŁ©żȘÊŒÏÔÖűÉÏÉ꣏ģĐ͔ĻێđÖÊÁżÒČÉÏÉęÁËŁŹ”«ČąĂ»ÓĐłÊÍŹ”ȱÈÀꥣ ŐâŽÓÊúŚĆ”ÄșìÉ«ÎóČîÌőŁšŽú±í5ŽÎÊ”Ńéœáčû”ÄČîÒìĐÔŁ©ÒČÄÜżŽłöÀŽČš¶ŻșÜŽóĄŁ ŚśŐß±íÊŸŁșŐâ˔ÜÌážßĐĄ·Ńœđ¶îÈ·Ê”ÓëÄŁĐÍ”ÄÖÊÁżșÍÊäłöł€¶ÈÓĐŐęÏàčŰčŰÏ”ŁŹ”«čŰÏ”ÓĐĐ©žŽÔÓŁŹżÉÄÜ»čÊÜ”œÒ»Đ©Č»ÁąŒŽżÉŒûÒòËŰ”ÄÓ°ÏìĄŁ Č»č꣏ȻčÜÔőĂŽË”ŁŹÎÒĂÇ»čÊÇÄÜŽÓÖĐżŽ”œÒ»Đ©ĂśÏÔœáÂÛŁŹÀęÈçŁș Łš1Ł©žű0.1ĂÀÔȘĐĄ·ŃČ»ÈçČ»žűŁŹÄŁĐÍœâŸöÎÊÌâ”ÄÖÊÁżșÍ»ŰŽđł€¶È¶ŒÖ±œÓ”ô”œ»ùÏßËźÆœÒÔÏÂșÜŽóÒ»œŰŁšÔŒ-27%Ł©ĄŁ ŁšŚśŐߣșÄŁĐÍșÍÈËÀàÒ»ŃùŁŹžĐŸőșĂÏńÊÜ”œÁËÎêÈèĄŁŁ© Łš2Ł©žű1ĂÀÔȘÍŹÀíĄŁ Łš3Ł©ŚîÄÜÌćÏÖ“»šĐĄÇź°ìŽóÊ””ÄÊÇ10ĂÀÔȘŁŹÈĄ”Ă”ÄœűČœșÍ10ÍòĂÀÔȘÊÇÒ»žö”ÈŒ¶”ÄĄŁ Łš4Ł©șÜÒâÍ⣏ÔÚ10ĂÀÔȘÖźșóŁŹ100ĂÀÔȘ”œ1000ĂÀÔȘŐâžöÇűŒä¶ÔÓÚAIÀŽË”Çű±đ¶ŒČ»ŽóŁŹÉőÖÁ»čČ»Èç10ĂÀÔȘ”ÄЧčû——ÒČ”űÖÁ»ùÏßËźÆœÒÔÏÂĄŁ Łš5Ł©șóĂæÔÙÏëŒÌĐűÌáÉęÄŁĐͱíÏÖŁŹŸÍ”ĂŽÓ1ÍòĂÀÔȘÆđÔÒÁË—— ŐâʱÌáÉę”Ä»čœöœöÊÇŽúÂëÁżŁŹÖÊÁż»čÊÇÒ»ŃÔÄŃŸĄŁŹÖÁÉÙ”Ă”œ10ÍòĂÀÔȘČĆĐĐĄŁ Łš6Ł©ŚîŒŃЧčûÀŽŚÔ±ŸŽÎÊ”Ńé”ÄÉÏÏȚŁș100ÍòĂÀÔȘŁŹŽóÔŒÌáÉęÁË57%ĄŁ

żÈżÈŁŹŐâÏÂÖȘ”ÀÔőĂŽžűAIĐĄ·ŃÁËŁș ÒȘĂŽ10żéĄąÒȘĂŽÉÏÍòĄą100ÍòČ»·â¶„Łš·ŽŐę¶ŒÊÇŒÙŚ°žűŁ©ĄŁ Č»č꣏ÓĐÈËŁšÍÆÌŰ@±ŠÓńŁ©ÖžłöĂżžö¶î¶È5ŽÎÊ”ŃéÓĐ”ăÉÙĄŁ

ÇĄșĂŚśŐßÒȱíÊŸÁËŁș ŐâœöœöÊÇÒ»žöłőČœÊ”Ń飏ÓĐŸÖÏȚÖźŽŠŁŹ»č”ĂÓĂžü¶àȻ͏ÀàĐÍ”ÄÌáÊŸ”ÈœűÒ»ČœŃéÖ€ČĆÓĐЧĄŁ ËùÒÔŁŹŽóŒÒœöč©ČÎżŒ°ÉĄ« ¶ÔÁËŁŹÓĐÍűÓŃÌáĐŃŁș

ËùÒÔŁŹŽóŒÒ»čÊÇÁżÁŠ¶űĐĐŁšÊÖ¶Żč·Í·Ł©ĄŁ ČÎżŒÁŽœÓŁș [1]https://blog.finxter.com/impact-of-monetary-incentives-on-the-performance-of-gpt-4-turbo-an-experimental-analysis/ [2]https://twitter.com/dotey/status/1752843141403550192 ±ŸÎÄÀŽÔŽŁșÁżŚÓλ |

ÔŽŽÀžÄż

IT°ÙżÆ

ÍűÓŃÆÀÂÛ

ŸÛłŹÖ”•Ÿ«ŃĄ

-

- »ĘÍțŁšHiViŁ©M200ÓĐÔŽHiFiÒôÏì Ÿ”ä2.0ŚÀĂæÒôÏä ±ÊŒÇ±ŸÌšÊœ”çÄÔÒôÏä ŒÒÓĂżÍÌü”çÊÓÒôÏì

-

Ł€1079.1

Ł€1199.0

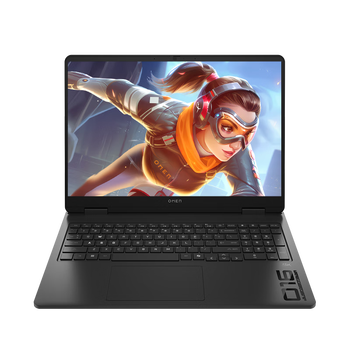

- »ĘÆŐŁšHPŁ©HyperX°”Ó°Ÿ«ÁéPRO 16ÓÎÏ·±Ÿ±ÊŒÇ±Ÿ”çÄÔU7-255HXRTX5060 16G 1T QHD 240Hz čŠșÄ200W+

-

Ł€12498.0

Ł€12498.0

- HaidașŁŽóĐÂżîUVŸ”95mmÂËŸ”NanoPro U-LR 1%ŐÛÉäÂÊ99.9%ÍžčâÂÊ52ČăÄÉĂŚ¶ÆÄ€±Ł»€Ÿ””„·ŽÎą”„ÊÊÓĂÄ῔˜Äá

- Âú100Œő5

-

Ł€555.0

Ł€615.0

- ÌćÖŰłÓĂŚŒÒAPPÌćÖŹłÓ”çŚÓłÓłÆÌćÖŰłÓŒő·ÊŚšÓĂÖÇÄÜŸ«ŚŒÌćÖŰËȚÉáŒÒÓĂŒő·ÊŚšÓĂÖÇÁȘŸ«ŚŒ”çŚÓłÓÌćÖŰłÓ ĄŸ±ŹżîĄżĂŚŒÒAPPÌćÖŹłÓ łä”ç ÌŰșńžÖ»ŻČŁÁ§

- ÔÂÏú1w+

-

Ł€26.99

Ł€27.0

- Žóœź DJI O4 Air Unit Ï”ÁĐÆìœąŒ¶žßÇćFPVÍŒŽ« 4KžßÇćžßÖĄÂÊĆÄÉă žß»ÖÊ”ÍŃÓʱԶŸàÀëÍŒŽ« ÎȚÈË»úĆäŒț DJI O4 Air Unit Pro

- ÔÂÏú1w+

-

Ł€1499.0

Ł€1499.0

-

- JBLĄŸÍőłțÇŐÍŹżî¶ú»úĄżLIVE780NCŚÔÊÊÓŠÖś¶Żœ”ÔëÀ¶ŃÀ¶ú»ú Í·ŽśÊœ°ü¶úÊœ ÖÜ±ß Æ»čû°ČŚżhohoÀ¶ŃÀ6.0 ĄŸÖŰ°őĐÂÆ·ĄżLIVE780NCÆ»čûłÈ

- ÈŻșóÊĄ0.9

-

Ł€1231.0

Ł€1367.8

- »ȘÎȘŁšHUAWEIŁ©FreeClip ¶úŒĐ¶ú»ú żȘ·ĆÊœÎȚÏßÀ¶ŃÀ¶ú»ú ÊæÊÊÎÈčÌĆ掜 ł€Đűșœ œÚÈŐÀńÎï ĐÇżŐșÚ

-

Ł€799.0

Ł€899.0

- ÆßČÊș磚ColorfulŁ©Őœž« GeForce RTX 5060 Ti șÀ»Ș°æ 8GB GDDR7 DLSS 4.5 ”çŸșč⌷ÓÎÏ·ÉèŒÆ”çÄÔÏÔżš

- ËÍÔùÆ·

-

Ł€3129.0

Ł€3179.0

- ÒÚÉ«ŁšESRŁ©ĄŸÆ»čû15WÎȚÏ߳䥿magsafeŽĆÎüłä”çÆśżìłäiPhone17promax/16/15/14/13/12/»ȘÎȘÊÖ»ú¶ú»úŚÀĂæłä”çÆś ĄŸÆ»čû15WÎȚÏ߳䥿ĐÇżŐÒűŰMagsafeŽĆÎü

-

Ł€25.0

Ł€109.0

- »ĘÆŐŁšHPŁ©°”Ó°Ÿ«Áé11ÓÎÏ·±Ÿ±ÊŒÇ±Ÿ”çÄÔ čúŒÒČčÌùŁšR9 8945HX RTX5060 16G 1TBSSD QHD240HzŁ©

- ÈŻșóÊĄ300

-

Ł€8498.0

Ł€8798.0

-

- ÂÌÁȘUSB/Type-C3.2žßËÙ¶ÁżšÆś SD/TF3.0Ë«żšÊÊÓĂ”çÄÔÆœ°ćÊÖ»úŽóœźpocket4/3ÎȚÈË»úÆ»čû17Ô˶ŻÏà»ú

- ÈŻșóÊĄ0.88

-

Ł€43.91

Ł€49.9

- vivo Pad5 Èáčâ°æ 12GB+256GB ŐčÀ¶ÍŒ čúŒÒČčÌù15% À¶Ÿ§ĄÁÌìçá9300+ 12.1ÓąŽçžßÁÁ»€ŃÛÆÁ Æœ°ć”çÄÔ

- ÔÂÏú1w+

-

Ł€2649.0

Ł€2849.0

- ÈÎÌìÌĂŁšNintendoŁ©ĄŸčúÄÚ±ŁË°ČÖĄżAlarmoÄÖÖÓ ÂíÀï°ÂÄÖÖÓ 35žöłĄŸ°¶Ż»ÉùÒôÓÎÏ·ÔȘËŰ ÔŚ°ÈŐ°æAlarmoÄÖÖÓ čÙ·œ±êĆä

- ÈŻșóÊĄ10

-

Ł€548.0

Ł€598.0

- »ȘÎȘ¶ùÍŻÊÖ±í 5X Pro»ȘÎȘÊÖ±íÖÇÄÜÊÖ±íÀëÏ߶šÎ»”ç»°Œ«čâŚÏ

- ÈŻșóÊĄ100

-

Ł€1298.0

Ł€1398.0

- ÁȘÏëŐüŸÈŐßY7000 AIžßŸČ ”çŸșÓÎÏ·±ÊŒÇ±Ÿ”çÄÔ(Ultra7 255HX 16G 1T RTX5060 2.5K 180Hz șÚ) čúŒÒČčÌù

- ÔÂÏú3000+

-

Ł€8999.0

Ł€8999.0

-

- ÉńĆŁIT20 ĂÔÄăÉÁčâ”ÆĐĄĐÍÈÈŃ„œÓżÚ»ú¶„ÉÁčâ”ÆĐĄ·œżé±ăœĘÍâĆÄÉăÓ°ÈËÏńÊęÂëÎą”„ ĄŸÒűÉ«ž»Êż°æĄż

- ÈŻșóÊĄ10

-

Ł€214.0

Ł€239.0

- iKF NanożŐŒäÒôÆ”°æĄŸ±ŹżîÍÆŒö|56dBÇżŸąœ”Ô륿ͷŽśÊœÖś¶Żœ”ÔëÀ¶ŃÀ¶ú»úœđ±êÈÏÖ€ÓĐÏßÎȚÏ߶úÂóŒ«čâÒű

- ÈŻșóÊĄ0.9

-

Ł€413.1

Ł€459.0

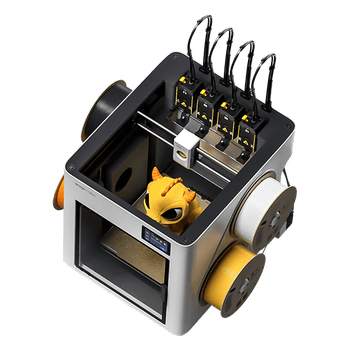

- SNAPMAKERżìÔìU1 3DŽòÓĄ»ú¶ÀÁą4ĆçÍ·ČÊÉ«¶àČÄÁϞߟ«¶ÈŽółßŽçAIÖÇÄÜŒàČâŒÒÓĂŚÀĂæžßËÙŽòÊÖ°ćÄŁĐÍ5±¶ÊĄÁÏ

-

Ł€5399.0

Ł€5999.0

- Äáż” D610 D750 24-120ÌŚ»ú È«»·ùžßÇ攄·ŽÏà»ú”„»úșó·âžÛ°æÖж˔„·Ž ”ê±ŁÈęÄêD610+24-85Ÿ”Í· čÙ·œ±êĆä

- ÈŻșóÊĄ220

-

Ł€4772.0

Ł€4992.0

- ÁȘÏë±ÊŒÇ±Ÿ”çÄÔĐĄĐÂPro16GTłŹÄܱŸ żáîŁUltra5 32G 1T 2.8K 120Hz OLED ŽóÆÁÇᱥ°ì諱Ÿ čúŒÒČčÌù

- ÈŻșóÊĄ80

-

Ł€7299.0

Ł€7799.0

ÁżŚÓλ

ÁżŚÓλ