̫ƽ��Ƽ� ��ҵ

�ϻƸ�H100����Ѫ����Ӣΰ���Ƴ���ģ�ͼ��ٰ���Llama2�����ٶȷ���

����λ

���ϱ༭���ư���

�����ڣ�2023-09-12 16:59

����λ

���ϱ༭���ư���

�����ڣ�2023-09-12 16:59

-

GPU����������һֱӰ���Ŵ�ģ�͵ı��֣�������Ӳ���ṩ����ʹ���߶�ϣ������ø���Щ������Ϊ��ģ�ͱ���Ӳ�������Ӧ�̣�Ӣΰ��һֱ���о���ô����ģ��Ӳ�����١�

|

��ģ�͵������ٶȣ�����һ���¾������һ���� Ӣΰ����չ�����H100�Ƴ���“��Ѫ��”——ר����LLM�����ļ��ٳ��� �������¿��Բ��ÿյ�������ܽ�����GH200�ˡ�

GPU����������һֱӰ���Ŵ�ģ�͵ı��֣�������Ӳ���ṩ����ʹ���߶�ϣ������ø���Щ�� ����Ϊ��ģ�ͱ���Ӳ�������Ӧ�̣�Ӣΰ��һֱ���о���ô����ģ��Ӳ�����١� ͨ������AI��˾������Ӣΰ�������Ƴ��˴�ģ�������Ż�����TensorRT-LLM(���Ҽ��TensorRT)�� TensorRT�������ô�ģ�͵������ٶȷ�����ʹ������Ҳʮ�ַ��㡣 ���������˽�C++��CUDA��Ҳ�ܿ��ٶ����Ż����ԣ���H100�ϸ�����ܴ�ģ�͡� Ӣΰ���ѧ�ҷ�����(Jim Fan)ת�������۳ƣ�Ӣΰ���“��һ������”���ǿ����������GPU���ܵ�����������

Ӣΰ��ͨ����������Ʒ��Ѫ���·���ʵ���ϻƵ��Ǿ�“���Խ��ʡ��Խ��”������Ҳ�������������ӹ�

���˼۸�Ҳ�����Ѷ�������Ч����������ɣ� �������ǿ���(�����е�)���ٱ����������������Լ�����Llama 2��ʱ��ÿ�뻹��ֻ�ܴ�����ʮ��token��

�����Dz��������Ч���ܻ���Ҫ�������飬�������������˽�һ��TensorRT�� ��ģ�������ٶȷ��� TensorRT-LLM�Ż�֮���H100���ܴ�ģ�͵����ж���أ� Ӣΰ���ͨ���и�����Llama 2��GPT-J-6B����ģ�͵����ݡ� ���Ż����H100�ϣ���Llama 2�������ٶ�����A100��4.6�������·�δ�Ż���H100��1.77����

��GPT-J-6B�������ٶ���A100�ϵ�8��������δ�Ż����2����

TensorRT���ṩ�˿�Դ��ģ�黯Python API�����ݲ�ͬLLM�������Կ��ٶ����Ż������� ���API�����ѧϰ���������ں��Ż���Ԥ/�����Ͷ�ڵ�ͨ�Ź��ܼ��ɵ���һ�� �������GPT(2/3)��Llama�ȳ���ģ�ͣ������Ѿ����ƺõİ汾������“���伴��”�� ͨ��TensorRT�����µĿ�ԴAI�ںˣ����������Զ�ģ�����������Ż������оͰ�������Transformer������ٵ�ע�����㷨FlashAttention��

��ôTensorRT������ζ�LLM�����ٶȽ����Ż����أ� ����Ҫ������TensorRT�Զ�ڵ�Эͬ������ʽ�������Ż��� ��Llama�����Ӵ��ģ�ͣ��ڵ��������ܲ������ģ���Ҫ���GPUһ���ܲ��ܴ����� ��ȥ����һ������Ҫ�����ֹ���ģ�Ͳ���ʵ�֡� ������TensorRT��ϵͳ�����Զ����ض�ģ�ͽ��в�֣���ͨ��NVLink�ڶ�GPU���Ч���С�

��Σ�TensorRT��������һ����Ϊ��̬���������Ż����ȼ����� LLM�����������У�ʵ�������ڶ��ִ��ģ�͵����� ��̬�����������Ὣ����ɵ����������߳��������ǵȴ�����������ɺ��ٴ�����һ������ ʵ�ʲ����У���̬��������LLM��GPU����������������һ�룬��������гɱ���

��һ���ؼ���������16λ���ȸ�����ת��Ϊ8λ�������Ӷ������ڴ����ġ� FP8��ѵ���ε�FP16������ĵ���Դ���ͣ�ͬʱ��ȷ���ָ���INT-8����������ܵ�ͬʱ��Ӱ��ģ�͵�ȷ�ԡ� ͨ��Hopper Transformer���棬FP16��FP8��ת��������ϵͳ�Զ���ɣ������˹���ģ���е��κδ�������ġ� Ŀǰ��TensorRT-LLM��������Ѿ��������أ���ʽ�潫�ڼ������Ƴ������ɵ�NeMo����С� One More Thing ÿ�����¼����֣����ٲ���“���Ļ���”����Ӱ�� Ӣΰ��Ĺ������ᵽ��“����Meta��AIͷ����˾����”����û���ἰOpenAI�� ������ͨ���У��������ѷ�����������㣬��������OpenAI��̳�ϣ� ���ҿ�����˭û���ϻ�cue�����ֶ���ͷ��

�㻹�ڴ��ϻƴ�������ʲô����“��ϲ”�أ� �ο����ӣ�https://developer.nvidia.com/blog/nvidia-tensorrt-llm-supercharges-large-language-model-inference-on-nvidia-h100-gpus/ ��Դ������λ |

ԭ����Ŀ

IT�ٿ�

��������

�۳�ֵ•��ѡ

-

- Canon����r100���ż������ ���м���ѧ��vlog��Ƶ���� 4kС�ɱ�Я�뻭��������� R100 18-45�� ������� �ٷ����䡾�����ڴ濨��� �Ƽ������ײ͡�

-

��3299.0

��3599.0

- SANCʢɫ27Ӣ��2K240Hz 1152����MiniLED�羺��ʾ�� QD���ӵ��ɫ�� HDR1000nit���� ������ĻS73mPro

- ����3000+

-

��1049.0

��1099.0

- Ӱ��GeForce RTX 5060 ħ��V2 OC Ӣΰ���Կ�

-

��2898.0

��2898.0

- ��ɫ��ESR����ƻ��15W���߳䡿magsafe������������iPhone17promax/16/15/14/13/12/��Ϊ�ֻ������������� ��ƻ��15W���߳䡿�ǿ���حMagsafe����

-

��25.0

��109.0

- ����thermalright���650W TR-TG650 ����ȫģ�� ȫ��ϵ������ 14CMС���� ATX3.0��Դ 80PLUS������֤

- ����Ʒ

-

��259.0

��279.0

-

- ���ֹٷ���Ʒ�¿�AI������������wifi�ƶ�����wifi6��������AI����ѡ��wifi���ض����л�·���� AI�������ܸ߽װ�����wifi-��ɫ

- ȯ��ʡ10

-

��37.8

��47.8

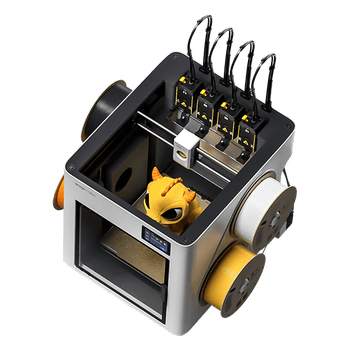

- SNAPMAKER����U1 3D��ӡ������4��ͷ��ɫ����ϸ߾��ȴ�ߴ�AI���ܼ�����������ٴ��ְ�ģ��5��ʡ��

-

��5399.0

��5999.0

- ���ϣ�SanDisk��2TB Type-c USB3.2�ƶ���̬Ӳ�̣�PSSD��E30���� �ƶ�SSD ����800MB/s �����ֻ��ʼDZ�����

- ����1000+

-

��1299.0

��1299.0

- ��������2026�¿��ֳ�С���ȡ��������ȱ�Яʽusb������㾲�������������˯�߽�����������С�͵��� ������+���� ��ɫ 3600mAh ��������ح��������

- ȯ��ʡ0.88

-

��77.44

��88.0

- ����������Y7000 AI�߾� �羺��Ϸ�ʼDZ�����(Ultra7 255HX 16G 1T RTX5060 2.5K 180Hz ��) ���Ҳ���

- ����3000+

-

��8999.0

��8999.0

-

- ���������èС����������Я�ֳ�С�����������usb��������Ȱ칫�����ṤλС�͵���ȹҲ������������ ��è�ն�̨ʽ���� ������������

- ȯ��ʡ19

-

��29.8

��48.8

- OPPO Find X9 Ultra 12GB+256GB ���ر��� 10��������۳��� ������ ��Ϸ 5G ������Ӱ�콢�ֻ��»�

- ����1w+

-

��7499.0

��7499.0

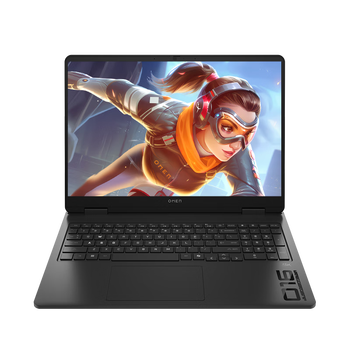

- ���գ�HP����Ӱ����11��Ϸ���ʼDZ����� ���Ҳ�����R9 8945HX RTX5060 16G 1TBSSD QHD240Hz��

- ȯ��ʡ300

-

��8498.0

��8798.0

- С���������������4˫��� ����500��+500����������ͷ�������ܼ������wifi ũ�� ���� ͥԺ

- ����1000+

-

��274.0

��299.0

- ����240����������û�Ϊ�����Mate60pro�ֻ����ͷ�����ͷmate50pro/30/40������ҫnova8/9������ 1.0��6A�����

- ��2��9��

-

��3.99

��4.0

-

- ���65Ӣ�����ƽ��һ�������ƽ�崥����һ�����ý���ѧһ���������ʾ���Ӱװ�������E65��װ

-

��4759.0

��4759.0

- ��ǿ�����2026���¿�حȫ����������������������ʽ�ǹǴ�������ʽ�������߲�����˶��ܲ���Ϸͨ������ �ѿպڡ�����Ultra��ح������ô����ʡ� �ű�ȫ����ح��������ح����ͨ��

- ��157��41

-

��58.8

��157.8

- ������deli���ܷ��a4 ���ð칫С����Ƭ���ܻ����ܹ���ѹĤ��Ĥ��Ĥ�� �����ܷ�Ĥa4�����»���Ĥ�ܷ�ֽ GQ403

-

��74.9

��74.9

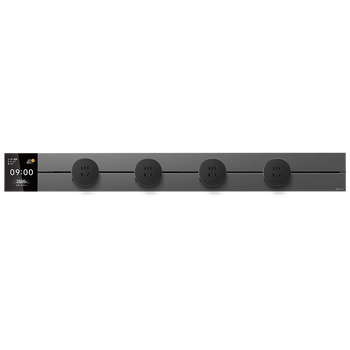

- ��ţ��BULL����ʦ�������Թ���������ƶ����߰���ʽ���Ųͱ߹ز������ ����+APP����gb3z 75cm+4�����

-

��769.03

��769.0

- �������ӣ�HIKVISION��ȫ����˷� 360������ 3��ʰ���뾶 ��Ƶ������˷� USB���弴�������� ������ר��300U(Pro)

- ȯ��ʡ25

-

��335.0

��360.0

����λ

����λ